¿Por qué los editores DiT derivan? Alineación de baja frecuencia plug-and-play en el espacio latente de VAE

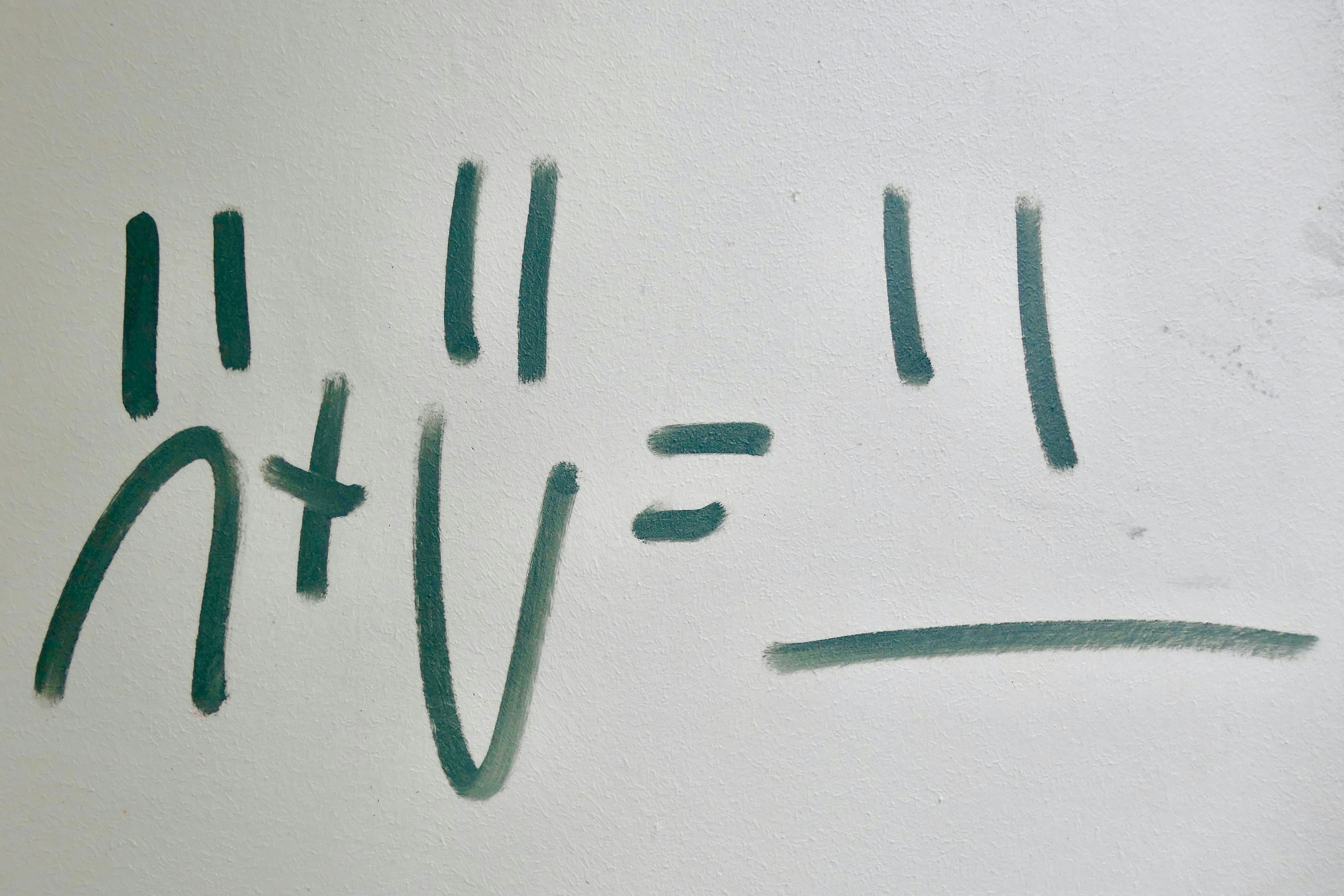

La edición de imágenes basada en modelos de difusión ha supuesto un avance significativo en la generación visual, pero cuando se aplica de forma iterativa —en múltiples rondas de modificación— surge un fenómeno técnico conocido como deriva semántica: pequeñas incoherencias que se acumulan y degradan tanto el contenido como la calidad del resultado final. Este problema afecta especialmente a los denominados Diffusion Transformers (DiT), arquitecturas que combinan la potencia de los transformers con procesos de difusión en el espacio latente. La raíz del problema no está únicamente en el modelo generativo, sino en la interacción entre el codificador-decodificador VAE (Variational Autoencoder) y el propio DiT. Investigaciones recientes demuestran que el DiT introduce una deriva dominante en las frecuencias bajas del espectro latente, mientras que el VAE mantiene una distorsión de reconstrucción más estable. Esto sugiere que la solución no pasa por rediseñar el modelo completo, sino por alinear esas componentes de baja frecuencia entre rondas sucesivas de edición. Desde una perspectiva empresarial, esta deriva semántica representa un obstáculo para aplicaciones a medida que requieren coherencia visual en flujos editoriales complejos, como la personalización masiva de catálogos o la generación automatizada de contenido para campañas de marketing. Técnicas como VAE-LFA (Low Frequency Alignment) proponen un mecanismo plug-and-play que, sin necesidad de reentrenamiento ni acceso a parámetros internos del difusor, filtra las discrepancias latentes mediante un paso de baja frecuencia y las alinea con una media móvil exponencial de rondas anteriores. Esto permite que el editor preserve los detalles de alta frecuencia —texturas, bordes— mientras suprime la deriva acumulada. En la práctica, esta solución es especialmente valiosa para sistemas de inteligencia artificial que operan en entornos productivos, donde la consistencia y la fiabilidad son críticas. Por ejemplo, una plataforma de ia para empresas podría integrar este tipo de alineación latente en sus pipelines de edición visual, garantizando que múltiples iteraciones sobre una misma imagen no introduzcan artefactos ni cambios indeseados. Además, al ser una técnica que no requiere modificar el modelo base, se puede combinar con otras capas de control como agentes IA que orquestan el flujo editorial o con servicios inteligencia de negocio que miden la calidad del contenido generado. El enfoque también tiene implicaciones en ciberseguridad, ya que la deriva semántica podría ser explotada para alterar sutílmente imágenes en procesos de verificación; un alineado robusto reduce esa superficie de ataque. Desde el punto de vista de la infraestructura, estas soluciones suelen ejecutarse sobre servicios cloud aws y azure, aprovechando recursos elásticos para el cómputo latente sin necesidad de hardware especializado. Empresas como Q2BSTUDIO, especializadas en software a medida y desarrollo de tecnología, pueden ayudar a implementar este tipo de algoritmos en entornos reales, diseñando middleware que encapsule la lógica de alineación y la exponga como un servicio más dentro de una arquitectura de microservicios. La integración con herramientas de power bi o sistemas de reporting permite monitorizar la calidad de las ediciones a lo largo del tiempo, mientras que los agentes IA pueden decidir cuándo aplicar la corrección en función de la deriva detectada. En definitiva, entender por qué derivan los editores DiT no es solo un ejercicio académico; es la clave para construir sistemas de edición visual robustos, escalables y listos para entornos empresariales donde la precisión y la consistencia son tan importantes como la creatividad.

Comentarios