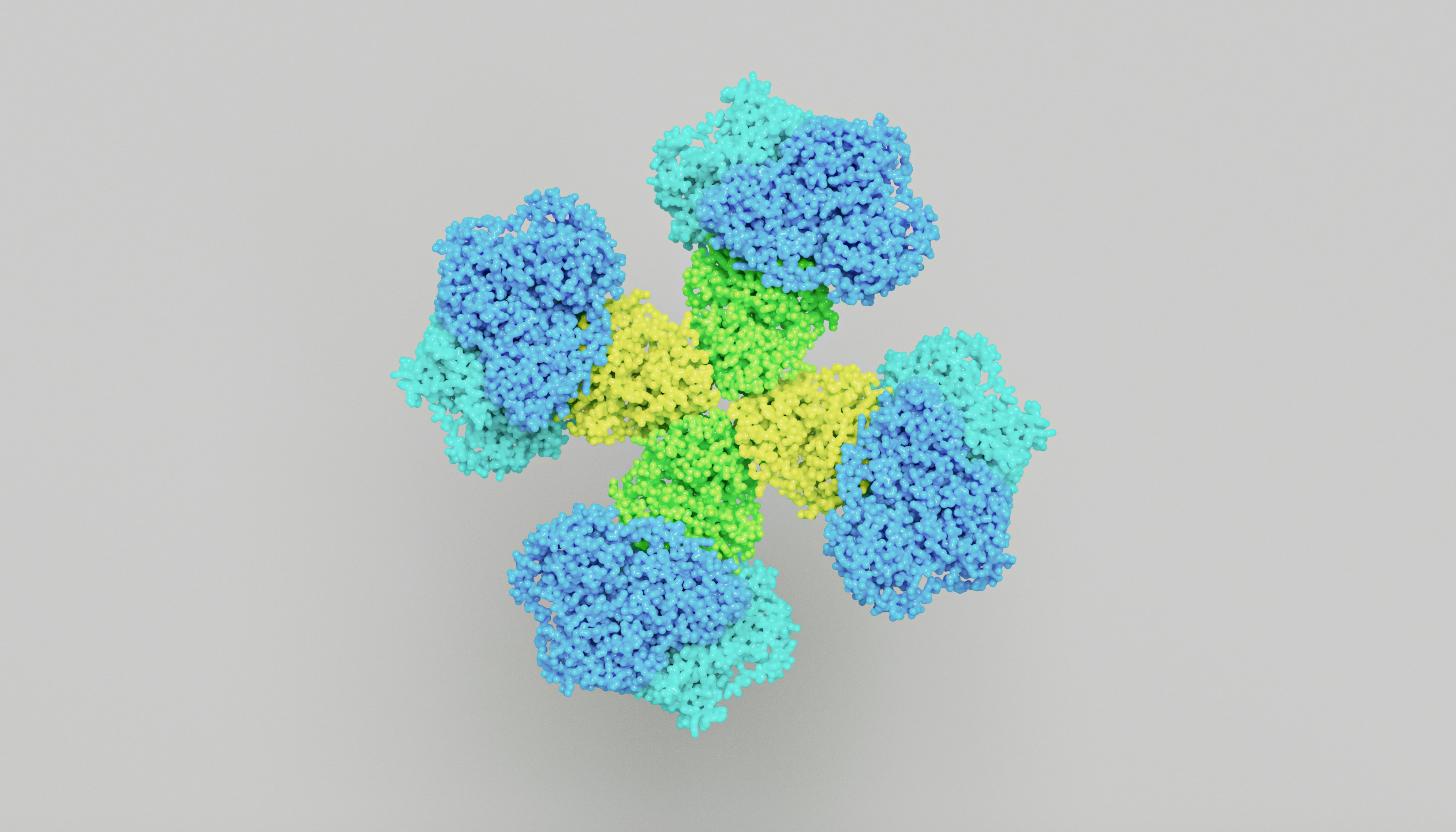

Yeti: Un tokenizador compacto de estructura de proteínas para reconstrucción y generación multimodal

La representación de datos biológicos tridimensionales ha sido durante mucho tiempo uno de los grandes desafíos para los modelos de inteligencia artificial, especialmente cuando se trata de integrar información de secuencias, estructuras y funciones en un mismo marco de trabajo. Para que un modelo multimodal pueda razonar sobre proteínas, necesita convertir coordenadas atómicas continuas en tokens discretos que sean escalables y expresivos. Aquí es donde surge la necesidad de un tokenizador compacto que no solo reconstruya con fidelidad, sino que también sea capaz de generar nuevas estructuras con propiedades funcionales diseñadas. Este enfoque permite entrenar modelos desde cero, sin depender de pesos preentrenados, y obtener resultados comparables a arquitecturas diez veces mayores, democratizando el acceso a la generación de secuencias y estructuras plausibles. En este contexto, las empresas que desarrollan aplicaciones a medida tienen la oportunidad de integrar estas capacidades en soluciones personalizadas para sectores como la biotecnología, la farmacia o la agroindustria. Por ejemplo, Q2BSTUDIO ofrece servicios de software a medida que permiten adaptar estas tecnologías de representación a infraestructuras existentes, optimizando el rendimiento y la escalabilidad.

La tokenización eficiente de estructuras proteicas abre la puerta a modelos multimodales que co-generan secuencias y conformaciones tridimensionales, algo fundamental para el diseño racional de proteínas. Al emplear técnicas de cuantización sin búsqueda y entrenamiento extremo a extremo con objetivos de flujo, se logra una alta diversidad de tokens y un uso óptimo del codebook, incluso con parámetros reducidos. Esto tiene implicaciones directas en el mundo empresarial: las compañías pueden beneficiarse de soluciones de ia para empresas que utilizan estos principios para acelerar la investigación y el desarrollo. Además, la integración con servicios cloud aws y azure facilita el despliegue de estos modelos a gran escala, garantizando elasticidad y seguridad. La ciberseguridad se convierte en un pilar cuando se manejan datos sensibles de proteínas o secuencias genómicas, y Q2BSTUDIO ofrece servicios especializados en protección de infraestructuras cloud. Los agentes IA pueden automatizar análisis complejos, mientras que las herramientas de inteligencia de negocio como power bi permiten visualizar resultados de simulaciones moleculares o predicciones estructurales, conectando la ciencia de datos con la toma de decisiones estratégicas.

La generación incondicional de secuencias y estructuras proteicas desde cero representa un hito en la capacidad de los modelos compactos, demostrando que es posible obtener resultados competitivos con recursos computacionales moderados. Esto tiene un impacto directo en la democratización de la inteligencia artificial para sectores que antes requerían clusters masivos. Las empresas que apuestan por aplicaciones a medida pueden integrar estos tokenizadores en sus pipelines de diseño de proteínas, combinándolos con técnicas de aprendizaje por refuerzo o búsqueda de secuencias. Q2BSTUDIO desarrolla soluciones personalizadas que aprovechan tanto la nube como la automatización de procesos, ofreciendo un ecosistema completo donde la tokenización eficiente se convierte en un habilitador clave. La combinación de servicios inteligencia de negocio con modelos generativos permite a los equipos de I+D tomar decisiones informadas basadas en datos tridimensionales, acelerando el descubrimiento de nuevos biomateriales o enzimas. En definitiva, la evolución hacia tokenizadores compactos y expresivos no solo mejora la calidad de las reconstrucciones, sino que allana el camino hacia una nueva generación de plataformas de diseño asistido por inteligencia artificial, donde la escalabilidad y la eficiencia son tan importantes como la precisión. Este enfoque, aplicado con criterio empresarial y técnico, representa una oportunidad real para transformar la forma en que interactuamos con el mundo molecular.

Comentarios