Sesgo de simplicidad distribucional y convexidad efectiva en modelos basados en energía

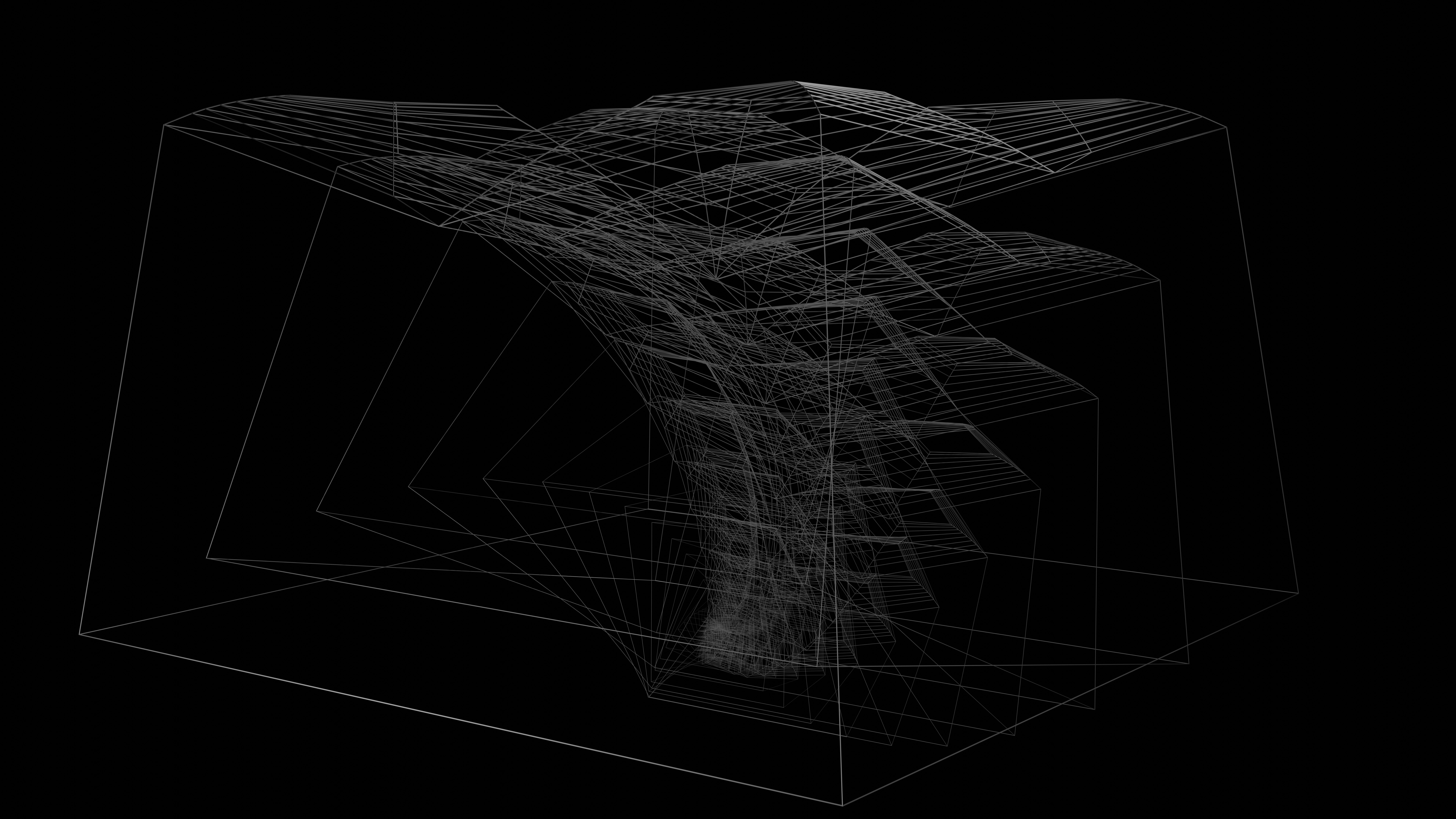

El estudio de los modelos basados en energía ha revelado un comportamiento fascinante durante el entrenamiento: tienden a capturar primero las regularidades más simples de los datos antes de refinar interacciones complejas. Este fenómeno, conocido como sesgo de simplicidad distribucional, sugiere que la dinámica del gradiente favorece de manera natural configuraciones de baja complejidad, lo que explica por qué ciertos puntos estacionarios que no reproducen la distribución objetivo rara vez se materializan en la práctica. En lugar de una búsqueda caótica, el proceso de aprendizaje sigue una jerarquía ordenada donde las correlaciones de bajo orden se fijan primero, proporcionando una convexidad efectiva que estabiliza la optimización incluso en paisajes no convexos.

Para las empresas que desarrollan soluciones de inteligencia artificial, comprender este sesgo es clave para diseñar arquitecturas robustas. Si un sistema generativo aprende primero las estructuras dominantes, se pueden anticipar comportamientos indeseados y guiar el entrenamiento hacia generalizaciones más sólidas. En Q2BSTUDIO aplicamos este conocimiento al crear aplicaciones a medida que integran agentes IA capaces de adaptarse progresivamente a patrones de negocio, evitando sobreajustes tempranos. Nuestro enfoque combina principios teóricos con implementaciones prácticas, como el uso de servicios cloud aws y azure para escalar modelos de energía en entornos productivos.

Además, el sesgo de simplicidad tiene implicaciones directas en la estabilidad de los puntos fijos. En lugar de perseguir configuraciones idénticas a los datos, muchos sistemas encuentran equilibrios que representan promedios estadísticos de baja energía. Esto permite construir módulos de ciberseguridad que detectan anomalías sin requerir una réplica exacta del comportamiento normal, reduciendo falsos positivos. De igual forma, los servicios inteligencia de negocio basados en power bi pueden beneficiarse de estos modelos para extraer patrones subyacentes sin saturarse de ruido. En Q2BSTUDIO ofrecemos software a medida que capitaliza esta propiedad, facilitando la integración de ia para empresas con una curva de aprendizaje predecible.

La jerarquía de aprendizaje ordenado también explica por qué los optimizadores modernos logran converger en problemas que, a primera vista, parecen intratables. Las soluciones espurias se evitan porque el sistema simplemente no encuentra gradientes suficientes para sostenerlas cuando las interacciones simples ya han sido fijadas. Esta convexidad efectiva es una propiedad emergente del entrenamiento, no una condición impuesta a priori. En la práctica, diseñar flujos de trabajo que respeten esta dinámica natural acelera el desarrollo de prototipos y reduce costes computacionales, algo que en Q2BSTUDIO aplicamos tanto en proyectos de automatización como en consultoría estratégica.

Comentarios