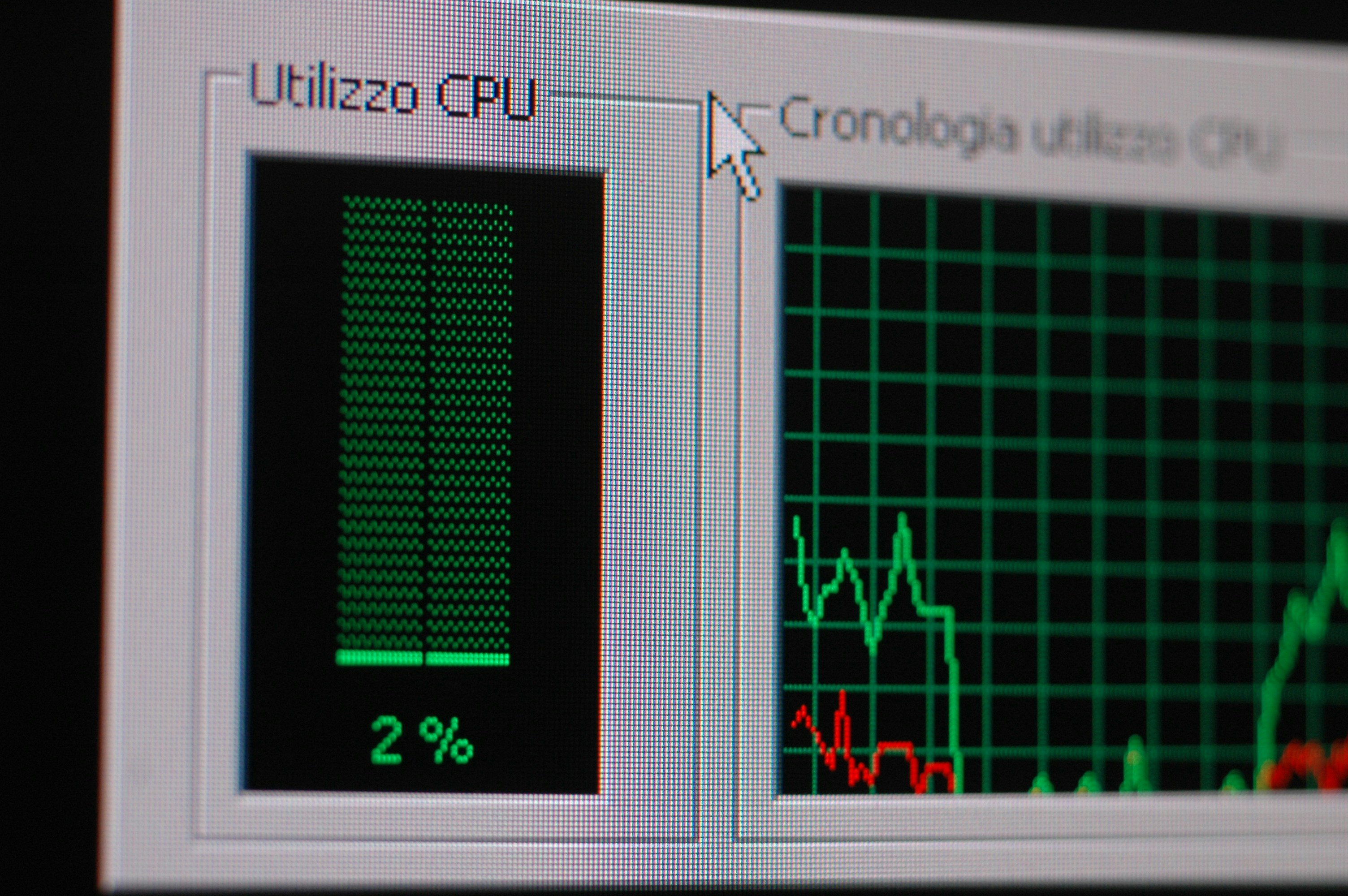

RL sin verificador para LLMs mediante recompensa intrínseca de norma de gradiente

RL sin verificador para LLMs: recompensa intrínseca por norma de gradiente optimiza el aprendizaje de forma eficiente y sin verificador externo.

RL sin verificador para LLMs: recompensa intrínseca por norma de gradiente optimiza el aprendizaje de forma eficiente y sin verificador externo.

Gradiente de Políticas en Aprendizaje por Refuerzo No Markoviano: descubre cómo optimizar políticas en entornos complejos con este enfoque avanzado de refuerzo.

CADBench: referente multimodal para generación de programas CAD con IA. Evalúa modelos de inteligencia artificial en diseño asistido por computadora.

<meta name=description content=AssayBench: benchmark de célula virtual para evaluar LLMs y agentes. Descubre su relevancia en la simulación celular y evaluación de inteligencia artificial.>

Descubre en qué casos la destilación on-policy mejora el rendimiento y cuándo puede ser perjudicial. Análisis detallado de sus ventajas y limitaciones.

<meta content=Aprende cómo los LLMs refactorizan código científico paralelo para mejorar la eficiencia energética. Reduce consumo y optimiza rendimiento en simulaciones. name=description>

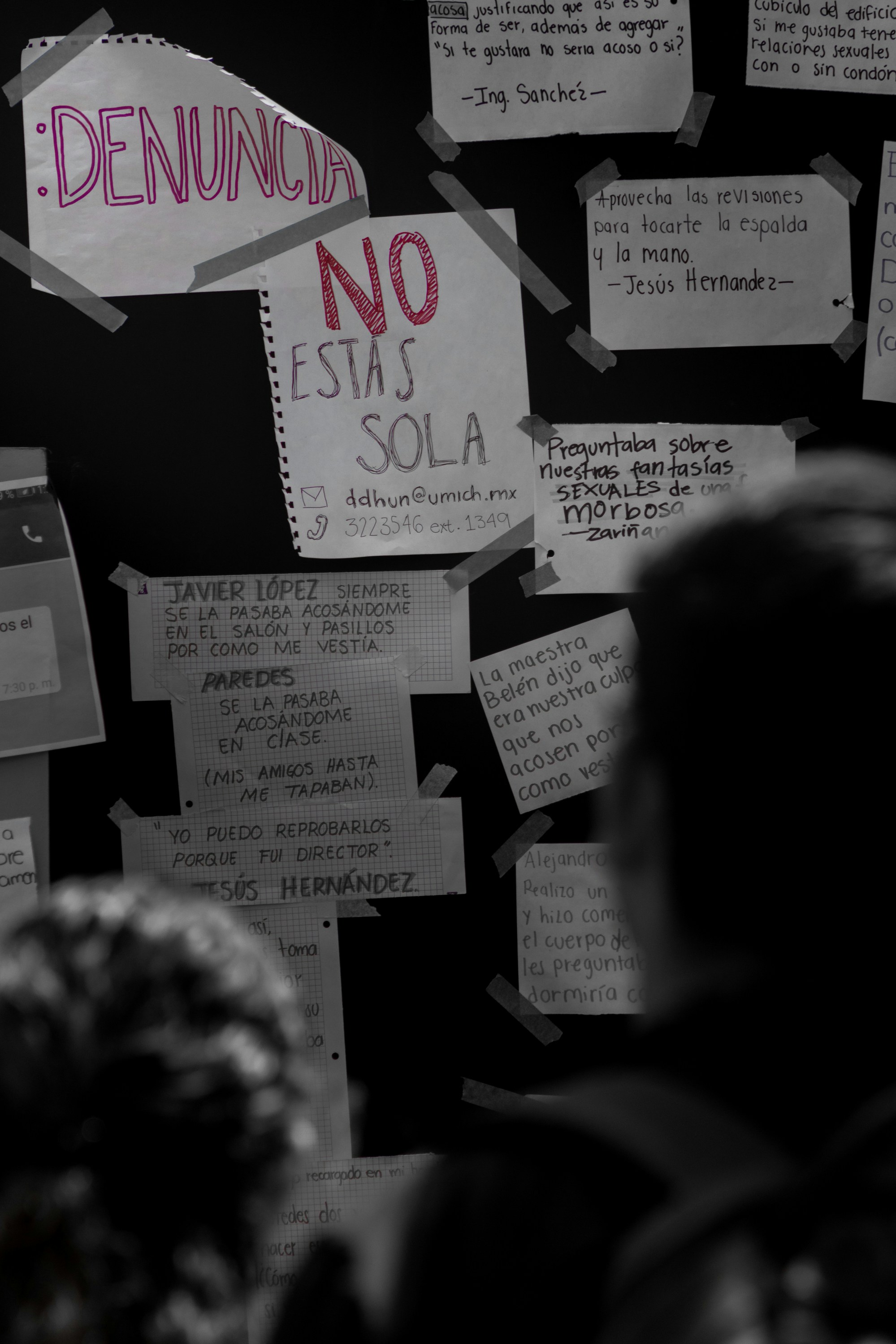

<meta name=description content=Punto de referencia para violaciones de restricciones por resultados en IA autónoma. Descubre cómo evaluar la seguridad en sistemas de IA.>

<meta name=description content=MePo es un metodo de refinamiento posterior meta para aprendizaje continuo sin ensayo. Optimiza la memoria sin repeticiones, ideal para modelos adaptables.>

<meta content=MePo: Meta Post-Refinamiento para Aprendizaje Continuo sin Ensayo. Descubre cómo mejorar modelos sin datos pasados, eficiente y escalable.>

Descubre cómo las preferencias latentes de usuario transferibles mejoran decisiones alineadas con humanos. Optimización SEO eficaz.

<meta content=MAP es un método que mapea el entorno antes de actuar, optimizando decisiones en agentes de horizonte largo. Descubre cómo mejorar la planificación y eficiencia en entornos complejos. name=description>

D-VLA: marco de aprendizaje por refuerzo distribuido de alta concurrencia para modelos VLA. Optimiza tareas complejas con eficiencia y escalabilidad.

Diversidad de extensiones en argumentación abstracta explora las distintas clases de extensiones y sus relaciones en la teoría formal.

<meta name=description content=Descubre cómo las restricciones locales afectan a los generadores de contenido por refuerzo. Optimiza tu estrategia adaptándote a estas limitaciones clave.>

SP-GCRL maximiza la influencia en redes incompletas. Descubre cómo este método optimiza la difusión incluso con datos parciales, mejorando campañas virales.

PERCEIVE es tu referencia para comprender emociones y comportamiento comunicacional en redes sociales. Aprende a analizar interacciones digitales de forma efectiva.

Descubre por qué los directorios curados por IA ofrecen mejor precisión y relevancia que los resúmenes de Google.

Aprende cómo el meta-aprendizaje por refuerzo optimiza la localización de emisores. Técnica avanzada para mejorar precisión en comunicaciones.

Descubre cómo entrenar LLMs con RL para respuestas personalizadas y conscientes de la intención. Mejora la relevancia y personalización de tus modelos de lenguaje.

Destilación on-policy multi-rollout con éxitos y fracasos de pares: técnica avanzada de aprendizaje por refuerzo que optimiza la eficiencia al combinar experiencias exitosas y fallidas de múltiples agentes.