Reconstruyendo composiciones de teoría de campos conformes con Transformers

Explora la reconstrucción de composiciones de teoría de campos conformes mediante Transformers. Un enfoque innovador que combina aprendizaje automático y física.

Explora la reconstrucción de composiciones de teoría de campos conformes mediante Transformers. Un enfoque innovador que combina aprendizaje automático y física.

<meta content=Explora la reconstrucción teórica de campos conformes mediante Transformers. Un enfoque innovador que conecta física teórica y aprendizaje profundo.>

Explora un marco para analizar representaciones de conceptos en modelos neuronales y mejora la interpretabilidad de la inteligencia artificial.

<meta name=description content=Aprende desarrollo de aplicaciones con inteligencia artificial en la práctica. Guía clara, ejemplos reales y herramientas clave para implementar IA.>

<meta name=description content=Marco para analizar representaciones conceptuales en redes neuronales. Descubre este enfoque innovador para entender el aprendizaje profundo y sus aplicaciones.>

<meta name=description content=Auditoría de composición LoRA con fusión residual y fiabilidad de vistas optimiza modelos de IA con técnicas avanzadas.>

CGFformer: transformador de frecuencia basado en clústeres para pansharpening. Mejora la fusión de imágenes satelitales con alta precisión.

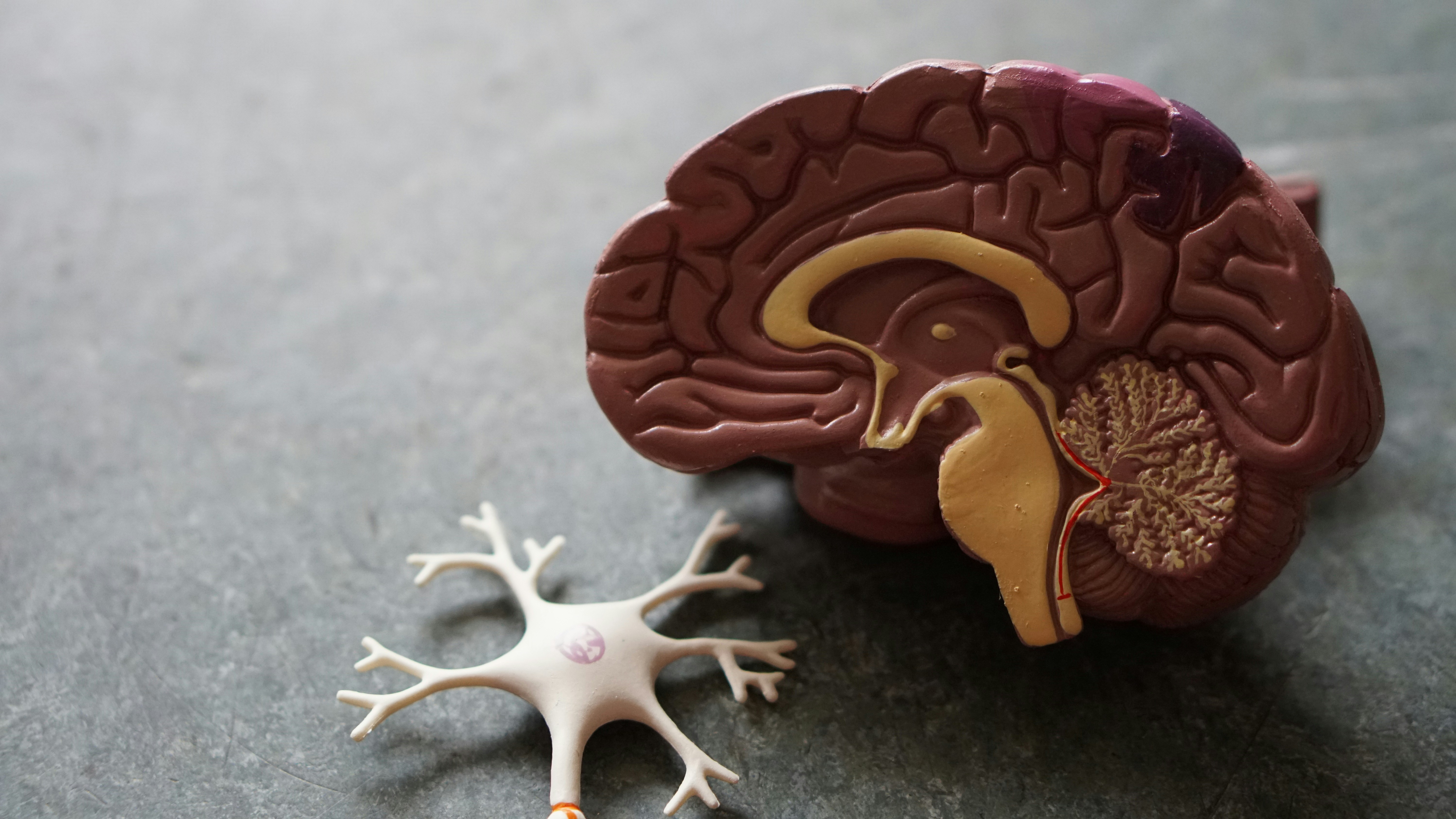

Explora cómo las redes neuronales de picos con coordinación retardada conectan el ritmo cortical con el aprendizaje inspirado en el cerebro. Un enfoque innovador en neurociencia computacional.

Explora cómo la sincronía cortical facilita el aprendizaje en una red neuronal de picos con retardo temporal. Un estudio clave en neurociencia computacional.

<meta name=description content=Predicción privada de diabetes gestacional con GNN federadas y pseudoetiquetado. Método innovador para preservar la privacidad de los datos clínicos.>

<meta content=Explora cómo el desequilibrio de etiquetas y la geometría afectan el colapso neuronal en clasificación multietiqueta. Análisis clave para optimizar modelos. name=description>

ShiftLIF introduce cuantificación de potencia de dos para neuronas espiculares, logrando eficiencia energética superior en redes neuromórficas.

<meta name=description content=Entrena redes no diferenciables con transporte óptimo. Aprende a optimizar modelos complejos con esta técnica avanzada y eficiente>

Explora el condicionamiento textual arbitrario con meta-puerta e hiperred. Un enfoque avanzado para el procesamiento del lenguaje natural.

<meta name="description" content=Visualiza en tiempo real los pases hacia adelante y atrás en el entrenamiento de redes neuronales. Comprende el flujo de datos y optimiza tu modelo.>

<meta name=description content=Mejora la calidad de imágenes satelitales con RAFNet, un método de pansharpening que utiliza fusión consciente de regiones para resultados nítidos y precisos.>

Alineación geométrica y espectral en redes neuronales profundas I. Explora conceptos clave, teoría y aplicaciones en deep learning.

<meta name=description content=Alineación geométrica y espectral para redes neuronales profundas. Parte 2: técnicas avanzadas para optimizar el rendimiento de modelos.>

<meta name=description content=Transformers sin proyección con atención de kernel gaussiano. Técnica eficiente y novedosa en inteligencia artificial.>

Curvatura en KANs: penalizaciones para suavidad composicional. Aprende cómo aplicar estas penalizaciones para mejorar la suavidad y rendimiento de tus modelos.