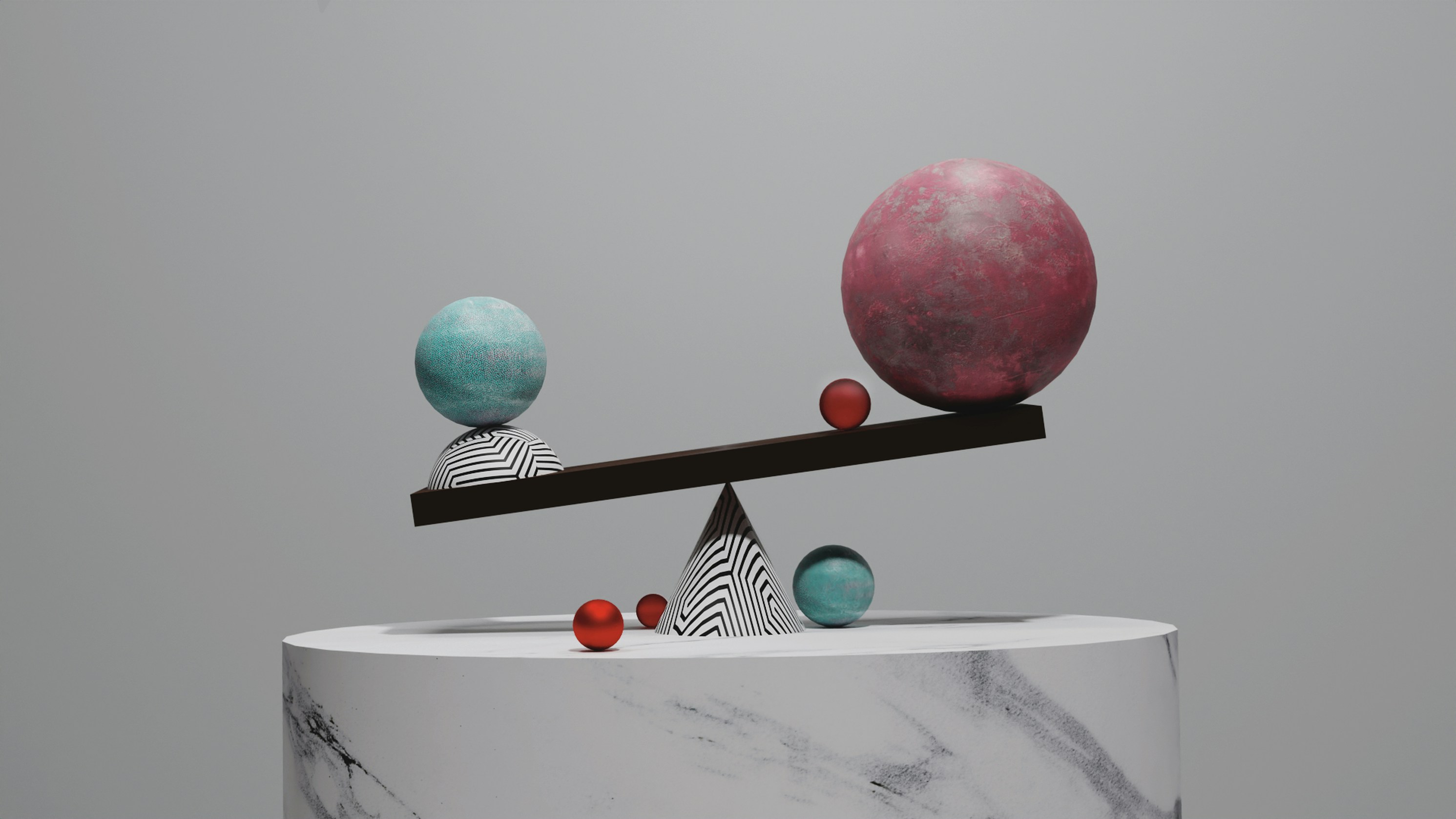

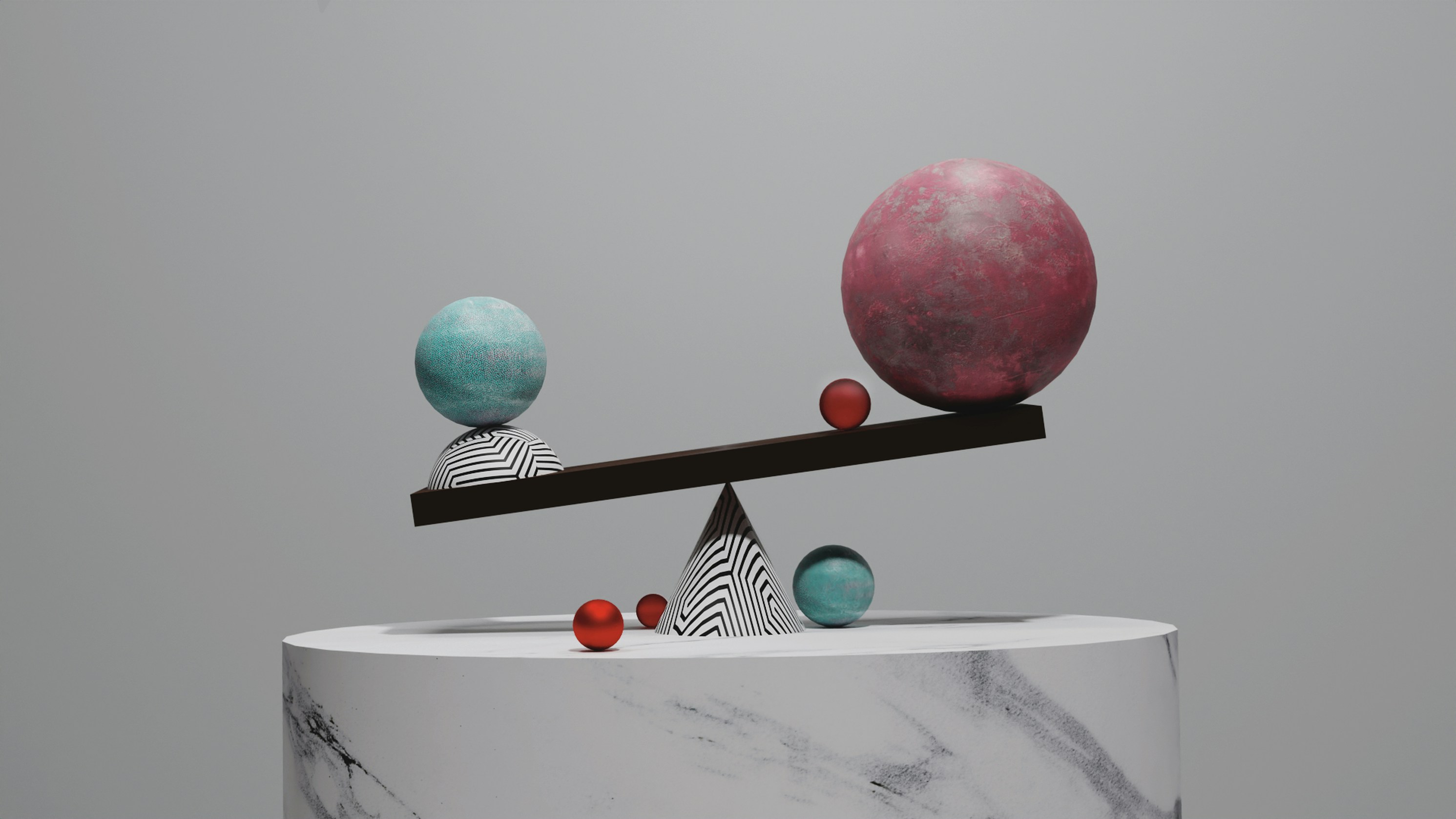

MARBLE: Balance de Recompensas Multi-aspecto para RL de Difusión

MARBLE presenta un balance de recompensas múltiples para RL de difusión. Optimiza el aprendizaje por refuerzo con este innovador método de recompensas equilibradas.

MARBLE presenta un balance de recompensas múltiples para RL de difusión. Optimiza el aprendizaje por refuerzo con este innovador método de recompensas equilibradas.

Atribución de clientes con privacidad en ajuste fino federado de LLM. Técnica innovadora para proteger datos en modelos de lenguaje.

Método para enseñar distancia métrica a modelos de lenguaje autorregresivos discretos, mejorando su representación de relaciones semánticas y espaciales.

Explicación de modelos de series temporales mediante mapas de prominencia en múltiples dominios. Descubre cómo esta técnica visual mejora la interpretabilidad en distintos campos.

Descubre por qué y cuándo el aprendizaje profundo supera al superficial gracias al modelo de transición de estados. Análisis clave para entender su rendimiento.

Modelado generativo de jerarquías celulares para inferencia robusta de linajes. Técnica avanzada que mejora el análisis de linajes celulares en biología computacional.

Optimización escalable de caja negra con inferencia posterior en espacio latente. Descubre métodos eficientes para mejorar modelos complejos sin acceso a gradientes.

<meta content=Descubre cómo el missingness y la selección de líneas base con relevancia médica mejoran la explicabilidad de modelos. Breve análisis técnico para profesionales.</meta>

<meta name=description content=Aprende cómo la inferencia contrafactual eficiente con etiquetas sintéticas optimiza el análisis causal. Descubre su aplicación y ventajas en investigación y machine learning.>

<meta name=description content=Protege modelos de difusión contra ataques de inferencia de membresía usando dinámicas de Langevin de orden superior. Técnica innovadora para seguridad en IA.>

<meta content=Rendimiento de Gemma-4-31B en benchmarks con TPU v6e-4>

Descubre cómo la destilación de caché KV optimiza el razonamiento latente en modelos de lenguaje, mejorando eficiencia y velocidad.

Descubre los riesgos de memorización en datos de clientes de LLMs para aprendizaje federado y cómo mitigarlos para proteger la privacidad y mejorar el rendimiento.

<meta content=Descubre un análisis profundo sobre datasets de prompts para LLMs. Explora perspectivas clave, tendencias y su impacto en el rendimiento de modelos de lenguaje. Ideal para investigadores y desarrolladores.>

<meta name=description content=Explicaciones alineadas para redes neuronales: mejora la interpretabilidad y confianza de tus modelos. Descubre técnicas y ventajas clave.>

<meta name=description content=LAMP: inferencia anticipada de precisión mixta para grandes modelos de lenguaje. Optimiza rendimiento y eficiencia en LLMs.>

<meta content=Optimización de caja negra con agentes para diseño biológico: métodos avanzados que aceleran la exploración y mejora de sistemas biológicos.>

<meta name=description content=Aprende a optimizar modelos de lenguaje enmascarado para ingeniería de proteínas. Descubre técnicas clave para mejorar predicciones y diseño molecular.>

Descubre por qué la atención linealizada no logra el régimen de kernel en anchos prácticos y sus implicaciones para modelos eficientes.

<meta name=description content=Descubre_la_fragilidad_oculta_en_la_interacción_multiplicativa_del_aprendizaje_contrastivo_multimodal._Un_análisis_que_revela_vulnerabilidades_en_modelos_multimodales.>