Memoria KV: Caché KV Independiente del Contexto sin Recomputación para LLMs

Memoria caché KV independiente diseñada para LLMs, optimizando el rendimiento de tus aplicaciones. Aumenta la eficiencia y velocidad en la gestión de datos.

Memoria caché KV independiente diseñada para LLMs, optimizando el rendimiento de tus aplicaciones. Aumenta la eficiencia y velocidad en la gestión de datos.

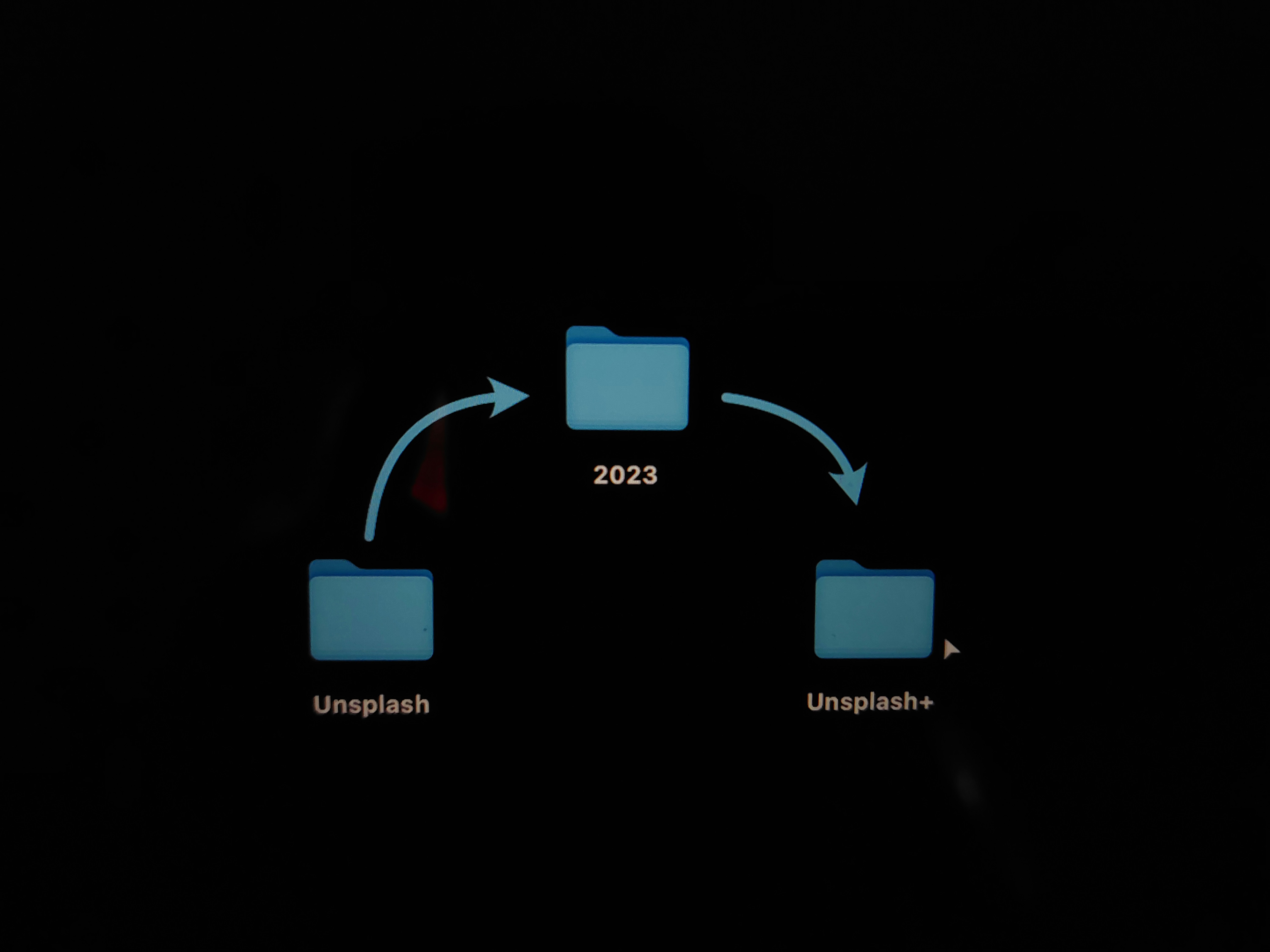

Lugares con almacenamiento en caché: Descubre los sitios que te permiten guardar información en caché para una navegación más rápida y eficiente. Aprende cómo optimizar tu experiencia online con estos espacios de almacenamiento en caché.