RL basado en resultados guía a transformers a razonar solo con datos adecuados

¿Sabías que los transformers pueden aprender a razonar con solo recompensas finales? Un nuevo estudio revela que los datos simples son la clave.

¿Sabías que los transformers pueden aprender a razonar con solo recompensas finales? Un nuevo estudio revela que los datos simples son la clave.

La planitud mínima de los interpoladores garantiza la generalización en modelos multi-índice con redes homogéneas.

Descubre cómo el método GL-RFE selecciona las características radiomicas más relevantes para detectar el estadio del cáncer de pulmón con un 90% de precisión.

Nuevo método descentralizado acelera la optimización convexa estocástica, logrando la tasa centralizada con más trabajadores. ¡Mejora el escalamiento en redes!

El nuevo algoritmo RT-PG reutiliza trayectorias off-policy para acelerar la convergencia en métodos de gradientes de política, mejorando la eficiencia muestral.

Nuevas cotas muestran que las colas de SGD y SGD recortado decaen exponencialmente más rápido. ¡Garantías a largo plazo mejoradas!

Descubre la comparativa de estimadores de gradiente (GS-ST, Score Function, Alternative Path) para inferencia en Gillespie SSA. Aplicado a sistemas biofísicos.

Descubre cómo los nuevos límites pseudoespectrales revelan amplificación transitoria en gradiente acoplado. Clave para optimización bilevel y adversarial.

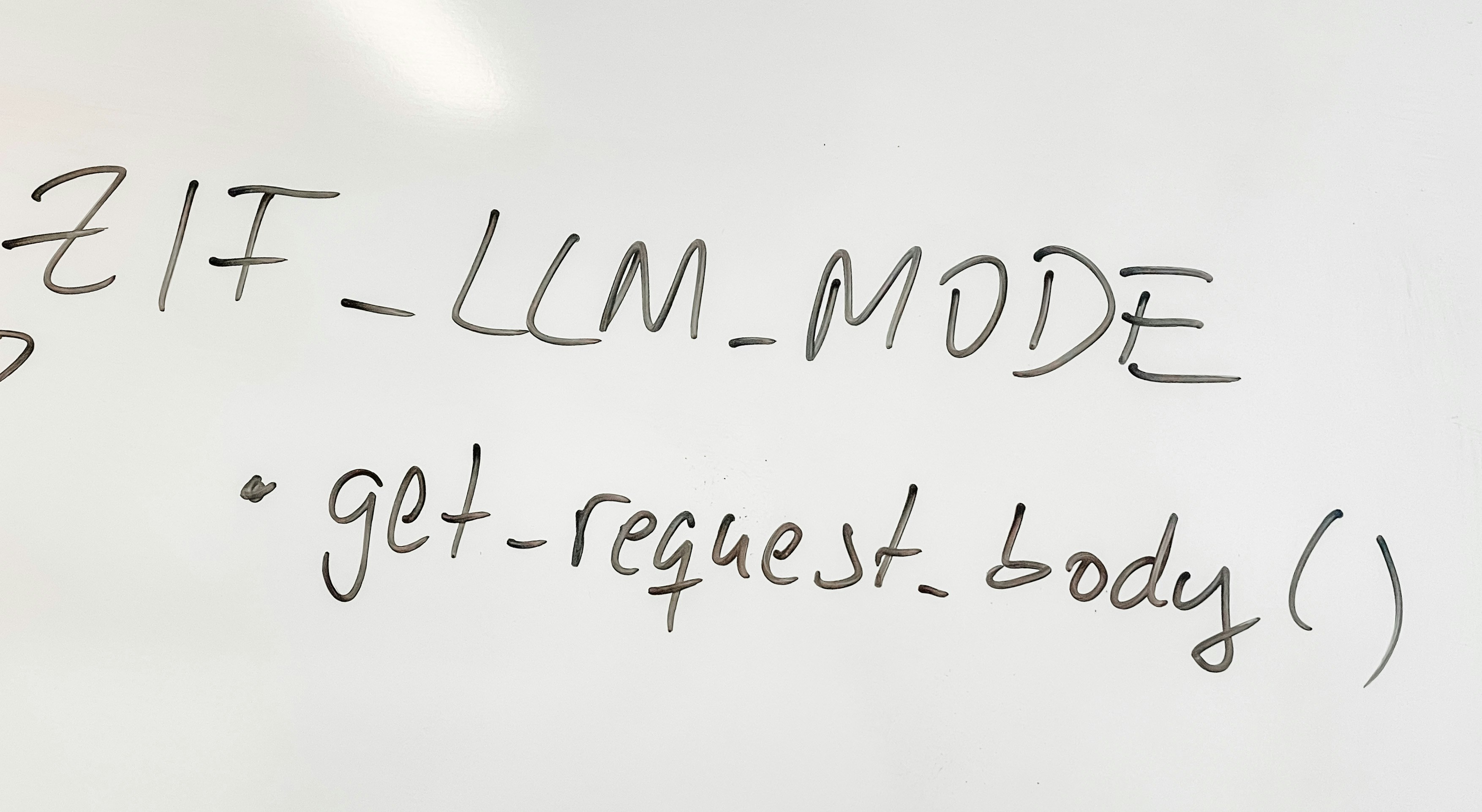

Descubre SDPG, un marco de gradiente de política autodestilada que estabiliza el entrenamiento de LLMs mediante autorefuerzo y ventajas de grupo.

Descubre cómo el borde de estabilidad redistribuye el aprendizaje entre grupos de datos, beneficiando a unos y suprimiendo a otros.

Descubre cómo los algoritmos de gradiente de política en tiempo continuo mejoran la robustez en MDPs, con convergencia lineal y menor complejidad muestral.

Descubre cuándo es posible usar menos coordenadas en DP-SGD sin perder rendimiento. El método TP-TopK optimiza el entrenamiento privado reduciendo el ruido.

Descubre cómo el nuevo algoritmo DPSR-CG logra privacidad diferencial rigurosa sin sacrificar el rendimiento del modelo en aprendizaje automático.

DPDL protege tu privacidad en aprendizaje descentralizado con datos no IID mediante calibración y ruido gaussiano. Logra velocidad lineal y alta precisión.

Aprende cómo el descenso de gradiente logra convergencia lineal en redes ReLU, evitando puntos silla y alcanzando el mínimo global.

Descubre cómo la optimización de gradiente bidireccional permite atribuir datos de entrenamiento en LLMs, mejorando la interpretabilidad y accountability de los sistemas de IA.

Mejora el algoritmo MADDPG con inferencia de acciones y muestreo por importancia para optimizar la cooperación y exploración en entornos multiagente.

El modelo ELFM-DEGDO combina evolución diferencial y gradiente descendente para mejorar representación de datos HDI, superando sesgos de optimización.

Muon duplica la eficiencia de Adam en LLMs gracias a menor curvatura. Descubre el análisis geométrico detrás de su ventaja.

IGA alinea gradientes en ejemplos lógicamente isomorfos para destilar razonamiento robusto en LLMs, con hasta 14.3% más precisión y 4x consistencia lógica.