No seas tan Stief: optimización de KV Cache en la variedad de Stiefel

Descubre cómo StiefAttention comprime el caché KV con aproximación de rango bajo en la variedad de Stiefel, mejorando precisión y eficiencia en modelos de lenguaje.

Descubre cómo StiefAttention comprime el caché KV con aproximación de rango bajo en la variedad de Stiefel, mejorando precisión y eficiencia en modelos de lenguaje.

ParisKV: recuperación de caché KV para LLMs largos, hasta 44x más rápido y robusto ante deriva. Optimiza tu inferencia.

Eso-LMs: modelos de lenguaje que combinan AR y MDM con atención causal y caché KV, permitiendo generación paralela e inferencia eficiente. Nuevo estado del arte.

StreamingVLM revoluciona la comprensión de video en tiempo real: procesa flujos infinitos con solo 8 FPS en un H100, superando a GPT-4O mini. ¡Descubre su arquitectura!

Nuevo marco logra robustez óptima en paginación asistida por aprendizaje, cerrando brecha al ratio H_k. Resultados experimentales demuestran su eficacia.

Conoce ConServe: programación por conversación para agentes LLM, reduce latencia 51% y mejora eficiencia energética en servidores IA.

ForesightKV optimiza la evicción de caché KV en modelos de razonamiento, superando métodos previos con la mitad del presupuesto y aprendizaje combinado.

Descubre cómo LRAgent comparte eficientemente la caché KV entre agentes Multi-LoRA, reduciendo memoria y cómputo sin perder precisión. ¡Optimiza tus LLMs!

Descubre Vegas: acelera LLMs hasta 2.81x usando atención dispersa guiada por verificación. Sin pérdida, código abierto.

Descubre WildCat, un nuevo método de atención que logra error mínimo en tiempo casi lineal. Ideal para modelos de IA con secuencias largas. ¡Lee más!

Descubre cómo las vulnerabilidades Copy-Fail y DirtyDecrypt afectan el kernel y cómo OpenShift las mitiga con defensa en profundidad. Lectura imprescindible.

Descubre Grokers: arquitectura que logra comprensión persistente de grafos tipificados con inteligencia en escritura, eliminando costos de LM en consultas. ¡100% hits en KV-cache!

Descubre BudgetDraft: entrenamiento multi-vista acelera decodificación especulativa con KV disperso hasta 6.55x en contextos de 4K a 16K, optimizando memoria.

Leyline introduce directivas para editar la caché KV sin re-prefill completo. Reduce latencia hasta 241 ms y mejora tasa de resolución en +14.3 pp.

Murmur: sistema de inferencia para ASR de larga duración que reduce la latencia 4.2x sin degradar la precisión. Atención dispersa y evicción de caché KV.

Mueve la consulta en lugar del caché KV y reduce la latencia en atención entre GPUs. Optimiza clusters H100 con RDMA.

STaR-KV comprime la caché KV en modelos GUI sin entrenamiento, reduciendo memoria GPU un 40% sin penalizar precisión. Descubre cómo.

WaveFilter mejora el rendimiento de LLMs de difusión en contexto largo mediante filtrado guiado por wavelets del caché KV.

¿Tu modo oscuro se desactiva solo al cabo de un minuto? Descubre las causas y los pasos definitivos para que se mantenga activo. ¡Lee la guía completa!

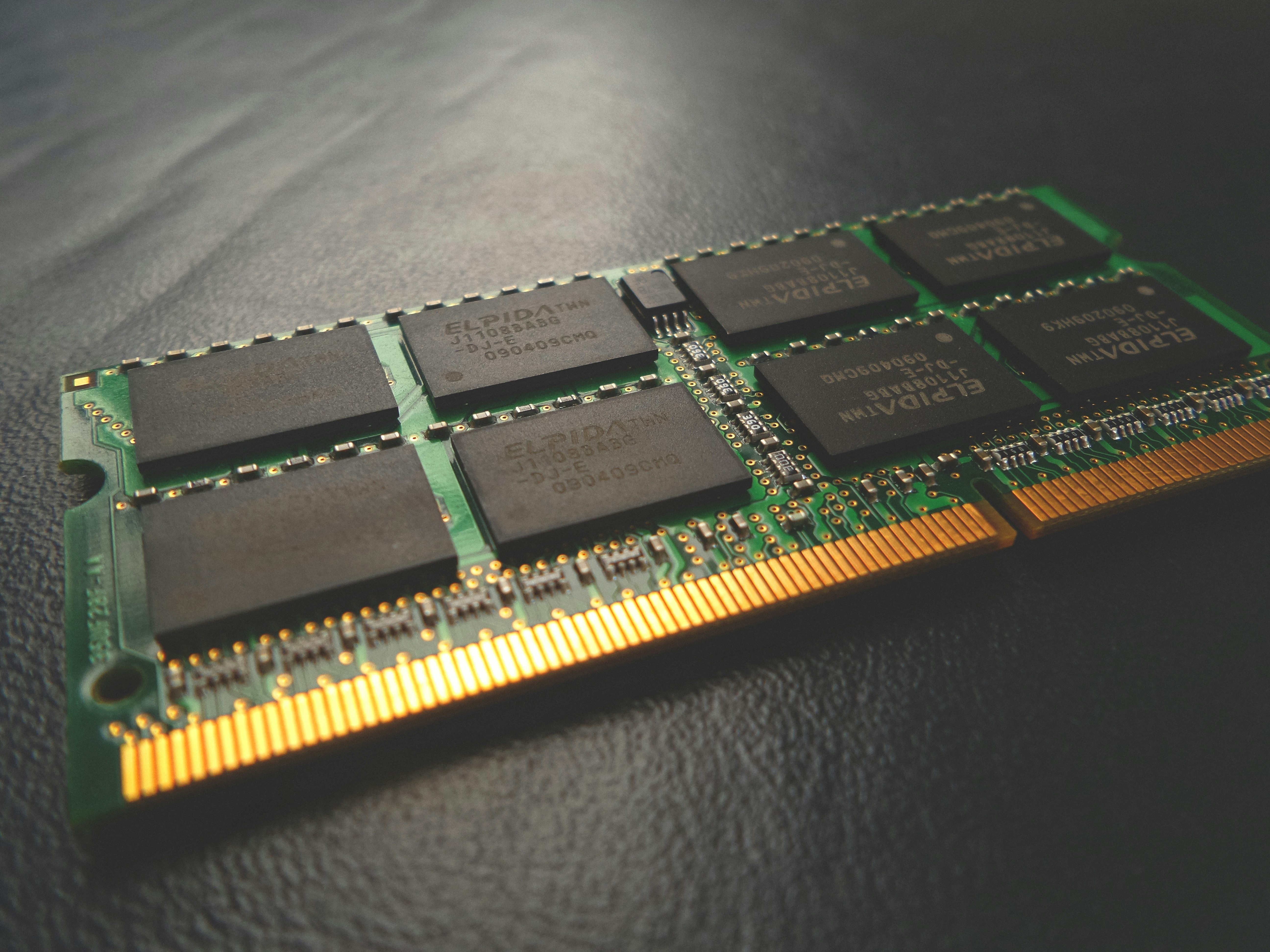

Descubre cómo Intel y Phison superan la limitación de memoria para ejecutar modelos de IA locales en laptops con solo 16GB de RAM. ¡Rendimiento sin compromisos!