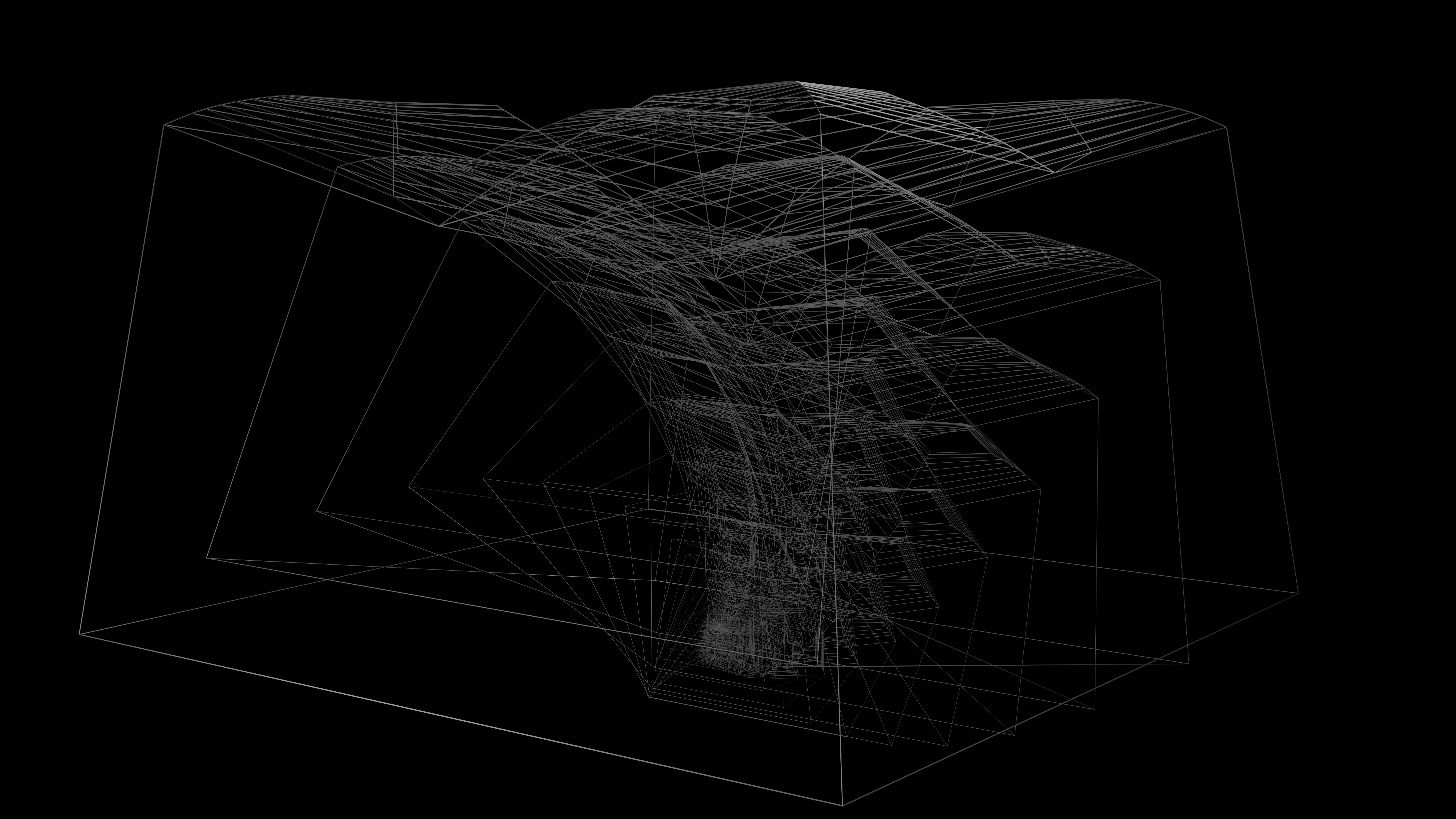

Transformación Multi-Estrecha como un Ensemble de un Solo Modelo: Condiciones de Contorno, Mecanismos y Modos de Falla

La optimización de arquitecturas de redes neuronales sigue siendo un desafío central en inteligencia artificial aplicada. Una línea de investigación que ha cobrado relevancia es la de los ensembles integrados en una sola red, donde se busca replicar las ventajas de combinar varios modelos independientes pero dentro de un único grafo computacional. Este enfoque permite aprovechar el presupuesto paramétrico sin multiplicar el costo de inferencia, a costa de introducir una decisión de diseño fundamental: ¿conviene concentrar la capacidad en una única vía ancha o distribuirla en múltiples ramas estrechas e independientes? La respuesta, como suele ocurrir en aprendizaje automático, depende del régimen de datos disponible y del nivel de redundancia deseado entre las representaciones internas.

En escenarios con datos abundantes, una arquitectura con un solo flujo de procesamiento ancho suele capturar patrones complejos de manera eficiente. Sin embargo, cuando la cantidad de ejemplos etiquetados es limitada, la diversidad inducida por múltiples ramas independientes —cada una con su propio subconjunto de parámetros— puede mejorar la generalización. Los experimentos sistemáticos muestran que en regímenes de pocos datos, modelos compuestos por muchas ramas estrechas superan consistentemente a sus contrapartes de una sola vía. El mecanismo subyacente radica en que esas ramas aprenden características menos correlacionadas y más diversas, lo que reduce el sobreajuste y favorece la transferencia del conocimiento. Por el contrario, cuando la muestra es grande, el entrenamiento tiende a desbalancearse: unas pocas ramas dominan la predicción mientras el resto permanece infrautilizado, anulando los beneficios de la multiplicidad.

Este hallazgo tiene implicaciones prácticas directas para el diseño de soluciones de inteligencia artificial para empresas. En contextos como la clasificación de imágenes con pocos ejemplos por clase o en dominios donde la adquisición de datos es costosa (por ejemplo, diagnóstico médico o detección de defectos industriales), la estrategia de particionar la capacidad en ramas múltiples ofrece un camino viable sin aumentar el número de parámetros total. En nuestra experiencia en Q2BSTUDIO, al desarrollar aplicaciones a medida de aprendizaje profundo, evaluamos este tipo de arquitecturas para clientes que necesitan soluciones robustas de IA para empresas con restricciones de datos. La decisión entre un modelo ancho o múltiples estrechos se convierte entonces en un hiperparámetro adicional que ajustamos según la disponibilidad de muestras y la complejidad del problema.

Más allá del ámbito de la visión por computadora, estos principios son transferibles a otros dominios donde se emplean arquitecturas profundas, como el procesamiento de lenguaje natural o los sistemas de recomendación. La clave está en entender que la asignación de la capacidad del modelo no es neutral: redistribuir recursos hacia la multiplicidad de miembros puede ser beneficioso precisamente cuando la redundancia informativa es baja y se necesita explorar diferentes hipótesis. No obstante, también impone costos de ingeniería, como la necesidad de gestionar ramas desbalanceadas o de implementar mecanismos de regularización específicos. Por eso, en proyectos que integran servicios cloud AWS y Azure, es común escalar dinámicamente la arquitectura según la fase del proyecto, combinando inteligencia de negocio (por ejemplo, con Power BI para monitorear métricas de rendimiento) y estrategias de ciberseguridad para proteger los datos sensibles.

En definitiva, la transformación que convierte un modelo único en un ensemble de múltiples ramas estrechas representa una herramienta valiosa dentro del arsenal de un ingeniero de machine learning. Su efectividad está condicionada por la cantidad y calidad de los datos, y su aplicación exitosa requiere un análisis cuidadoso del equilibrio entre ancho y profundidad. En Q2BSTUDIO, al ofrecer servicios de inteligencia de negocio y desarrollo de agentes IA, integramos estos conocimientos para diseñar sistemas que no solo sean precisos, sino también eficientes en el uso de recursos computacionales y adaptables a las condiciones reales de cada cliente. Entender cuándo y por qué falla o triunfa esta técnica es parte del camino hacia una inteligencia artificial más práctica y confiable.

Comentarios