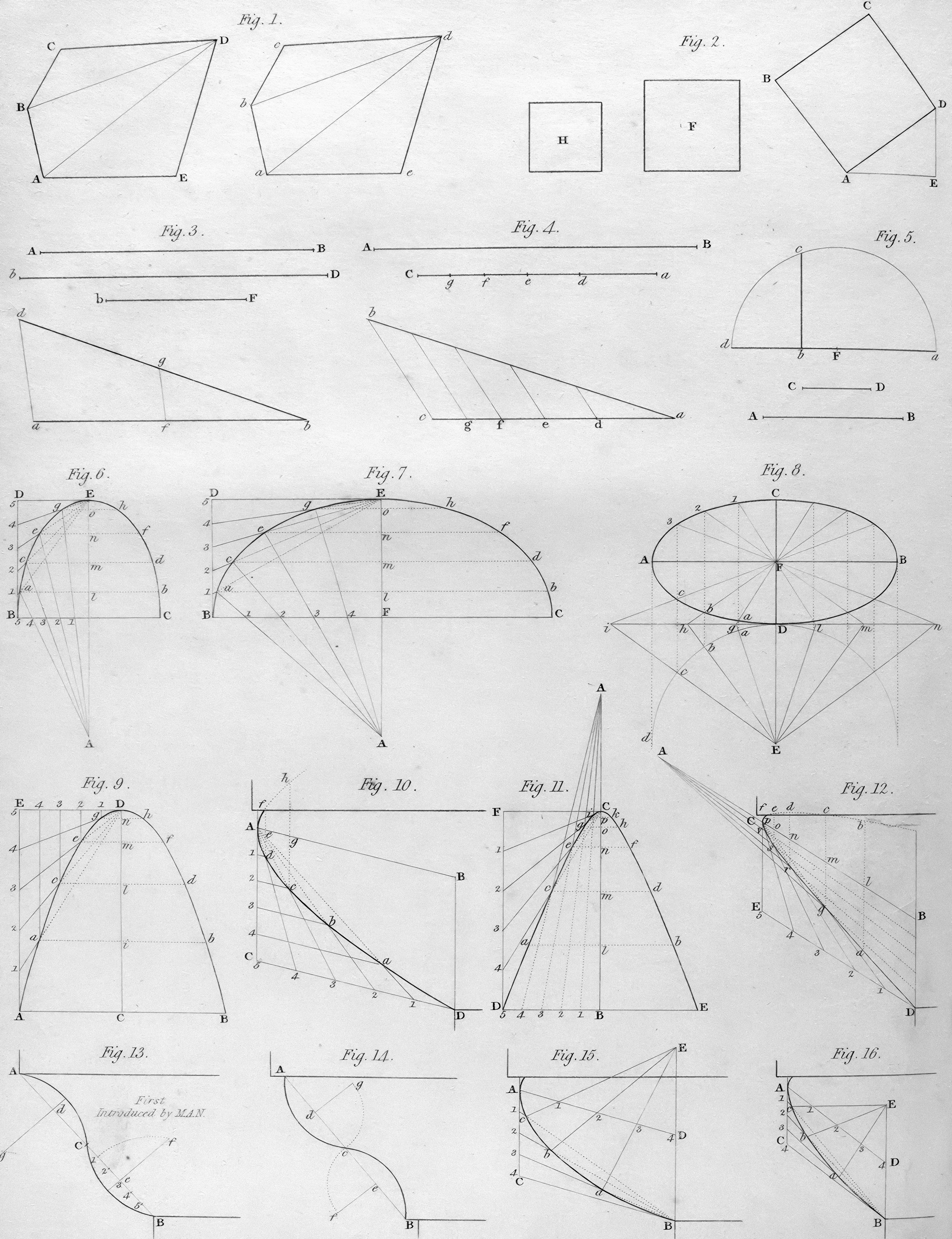

Una relación geométrica del error introducido al muestrear la distribución de salida de un modelo de lenguaje con respecto a su estado interno

Los modelos de lenguaje modernos generan texto seleccionando tokens de una distribución de probabilidad que refleja su estado interno. Sin embargo, cuando esa distribución es plana o presenta múltiples modas, pequeñas variaciones en la elección pueden producir cambios drásticos en la salida, lo que afecta la fiabilidad de sistemas que dependen de respuestas coherentes. Desde una perspectiva geométrica, esta sensibilidad puede entenderse como una propiedad del espacio de embeddings: la curvatura inducida por la disposición de los tokens condiciona cómo el modelo traduce su representación interna en decisiones discretas. Este fenómeno tiene implicaciones directas en el desarrollo de aplicaciones robustas, especialmente cuando se despliegan agentes IA que deben operar con predictibilidad en entornos críticos. Para una empresa como Q2BSTUDIO, comprender estas dinámicas es fundamental al construir ia para empresas que no solo sean potentes, sino también fiables. La relación entre el error de muestreo y la geometría interna del modelo abre la puerta a técnicas de regularización y ajuste que mejoran la consistencia, lo que resulta clave en sectores donde la ciberseguridad o la toma de decisiones automatizada exigen baja varianza. Por ello, al diseñar software a medida o implementar servicios cloud aws y azure, es necesario considerar cómo la arquitectura de representación afecta la calidad de las inferencias. Además, la monitorización de estos efectos puede integrarse con herramientas de servicios inteligencia de negocio como power bi, permitiendo visualizar la sensibilidad del modelo ante cambios mínimos. En definitiva, la geometría del espacio de tokens no es un detalle académico, sino un factor práctico que determina el rendimiento de las soluciones de inteligencia artificial, y Q2BSTUDIO aplica este conocimiento al desarrollar aplicaciones a medida que Maximizan la precisión y la estabilidad en entornos reales.

Comentarios