Reduce los costos de tokens de Claude Code

En el panorama actual del desarrollo de software asistido por inteligencia artificial, la eficiencia en el consumo de recursos se ha convertido en un factor crítico para equipos que integran asistentes como Claude Code en sus flujos de trabajo diarios. La arquitectura de estos sistemas, basada en modelos de lenguaje que operan sobre tokens, introduce una variable de coste que puede escalar rápidamente si no se gestiona con criterios técnicos precisos. No se trata únicamente de elegir el modelo más barato, sino de comprender cómo cada interacción, cada contexto cargado y cada herramienta invocada impacta en el volumen de tokens que atraviesan el sistema.

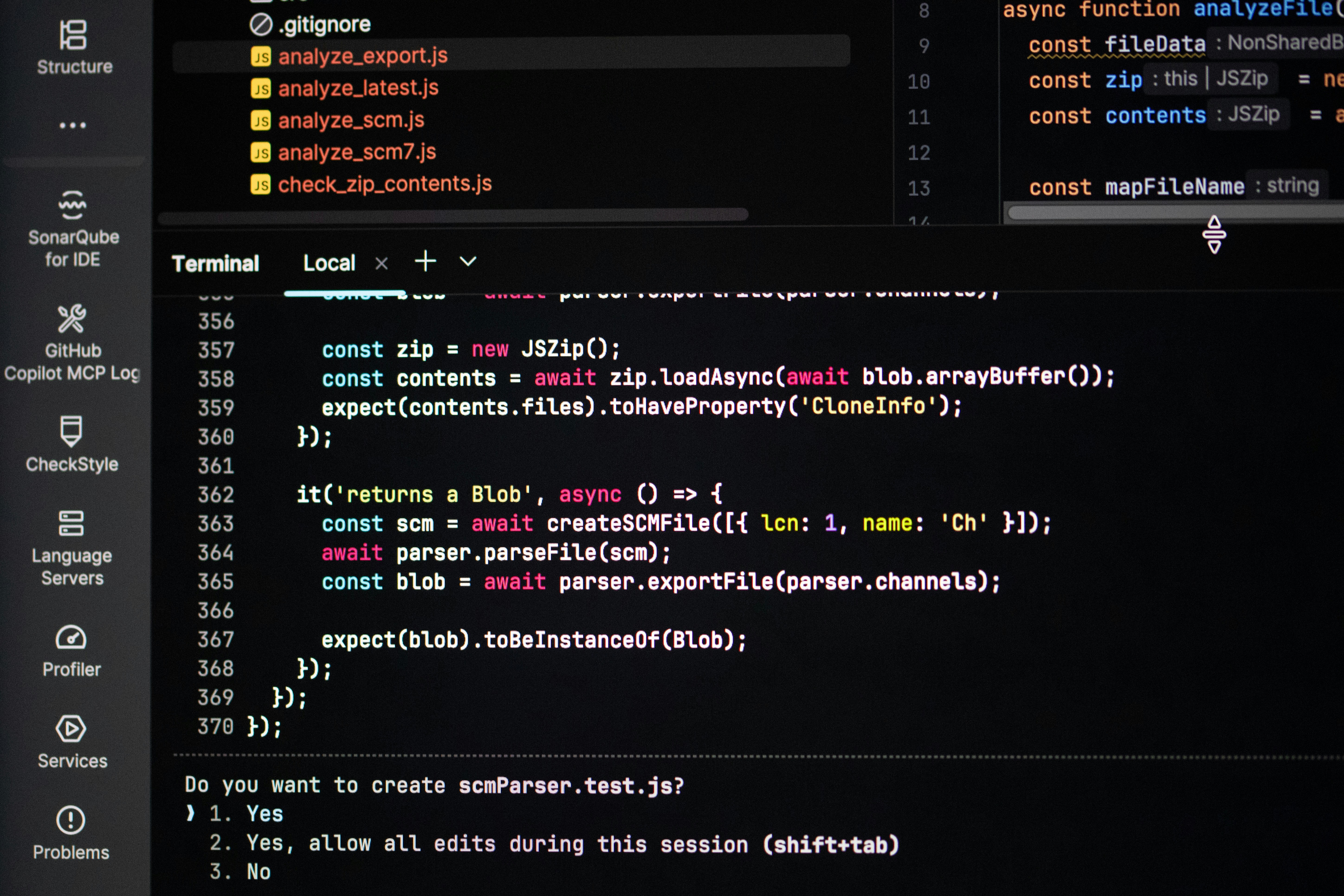

El punto de partida para cualquier estrategia de optimización es la visibilidad. Sin métricas claras sobre el consumo real, cualquier intento de reducción se convierte en una conjetura. Herramientas comunitarias permiten registrar cada edición, cada prompt y el coste por token desglosado por tipo: entrada, salida, lectura de caché o escritura. Esta información, que se alinea directamente con los modelos de facturación de los proveedores, es la base para tomar decisiones informadas. En Q2BSTUDIO, cuando abordamos proyectos de ia para empresas, siempre insistimos en que la medición precede a la optimización. No se puede gestionar lo que no se ve.

Una vez establecida la línea base, el siguiente paso consiste en comprimir los datos que llegan al modelo. Esto implica intervenir en los flujos de lectura de archivos, salidas de comandos de shell y resultados de herramientas, reduciendo el volumen antes de que el modelo los procese. Las implementaciones más eficaces actúan como proxies transparentes entre el asistente y el sistema de archivos, comprimiendo mediante algoritmos especializados que preservan la semántica esencial mientras eliminan redundancia. En entornos donde se releen los mismos ficheros repetidamente, las tasas de compresión pueden ser muy significativas. Este enfoque encaja perfectamente en el desarrollo de aplicaciones a medida, donde los ciclos de iteración sobre el mismo código base son constantes.

Otro frente de mejora sustancial es la gestión del contexto entre sesiones. Cada nuevo arranque de un asistente como Claude Code comienza sin memoria histórica, lo que obliga a reexplicar la arquitectura del proyecto, las convenciones de código y las reglas de negocio. Sistemas que capturan observaciones relevantes de sesiones anteriores y las inyectan bajo demanda pueden reducir drásticamente los tokens dedicados a recontextualización. En la práctica, esto se traduce en un ahorro acumulativo que, para equipos que trabajan en proyectos de larga duración con múltiples agentes, supone una diferencia sustancial en el presupuesto mensual. La implementación de estos mecanismos se integra de forma natural en estrategias más amplias de automatización, como las que ofrecemos desde nuestros servicios cloud aws y azure, donde la eficiencia operativa es clave.

Cuando el asistente se conecta a múltiples servidores de protocolo MCP, cada turno de conversación paga un coste fijo por la lista de herramientas disponibles. Agregar estos servidores tras una única interfaz con enrutamiento inteligente y gestión del ciclo de vida bajo demanda permite colapsar esa lista, reduciendo el overhead de cada interacción. Este patrón es especialmente relevante en entornos donde el número de integraciones supera la media, algo habitual en proyectos que requieren gobernanza de datos y ciberseguridad transversal. La consolidación no solo reduce tokens, sino que simplifica la arquitectura de integración.

En el extremo del espectro, algunas soluciones incorporan enrutamiento entre múltiples proveedores de modelos, incluyendo opciones alternativas a Anthropic. Esto permite elegir dinámicamente el modelo más económico para cada tarea, comprimiendo además las salidas de herramientas como diff, grep o tree antes de enviarlas. El impacto puede ser notable en términos de coste por petición, aunque introduce consideraciones adicionales de latencia, calidad de respuesta y tratamiento de datos. Para equipos que trabajan con presupuestos ajustados pero necesitan mantener un alto rendimiento, esta aproximación ofrece un equilibrio interesante. En este contexto, la inteligencia de negocio y el análisis continuo de métricas se vuelven herramientas indispensables para validar que cada cambio produce el efecto esperado.

Es importante destacar que ninguna de estas herramientas es una bala de plata. Las tasas de ahorro declaradas por los repositorios comunitarios deben verificarse en cada entorno específico, ya que dependen de factores como el tamaño del código base, la frecuencia de repetición de trabajo, la cantidad de servidores MCP configurados y el tipo de contenido procesado. Una estrategia sensata consiste en instalar los componentes de forma secuencial, midiendo el impacto de cada uno antes de añadir el siguiente. El orden recomendado empieza por la herramienta de medición, continúa con la gestión de memoria entre sesiones, sigue con la compresión de entradas, y solo después considera la agregación de servidores MCP o el enrutamiento a múltiples proveedores.

Desde una perspectiva empresarial, la optimización del consumo de tokens no es un ejercicio técnico aislado, sino una práctica que debe alinearse con los objetivos de eficiencia operativa y escalabilidad. En Q2BSTUDIO, cuando desarrollamos software a medida para nuestros clientes, integramos estos principios desde la fase de diseño, asegurando que los agentes IA que desplegamos operen dentro de márgenes de coste predecibles. La combinación de herramientas de compresión, gestión de contexto y enrutamiento inteligente, junto con un monitoreo continuo, permite a los equipos de desarrollo mantener la productividad sin sorpresas en la factura. La clave está en entender que el coste no es un atributo fijo del modelo, sino una consecuencia del diseño de la interacción. Y como tal, puede y debe ser gestionado.

Comentarios