Una breve prueba de la convergencia casi lineal del descenso del gradiente adaptativo bajo crecimiento de cuarto orden y convexidad

El descenso del gradiente es un método fundamental en la optimización, especialmente en el contexto de problemas que involucran funciones suaves y convexas. En particular, cuando se trata de funciones que presentan un crecimiento quartico con respecto a sus minimizadores, la convergencia del algoritmo puede ser optimizada. Esto despierta un interés considerable en los círculos académicos y empresariales, ya que una convergencia más rápida tiene importantes implicaciones para el rendimiento de las aplicaciones que dependen de estos métodos de optimización.

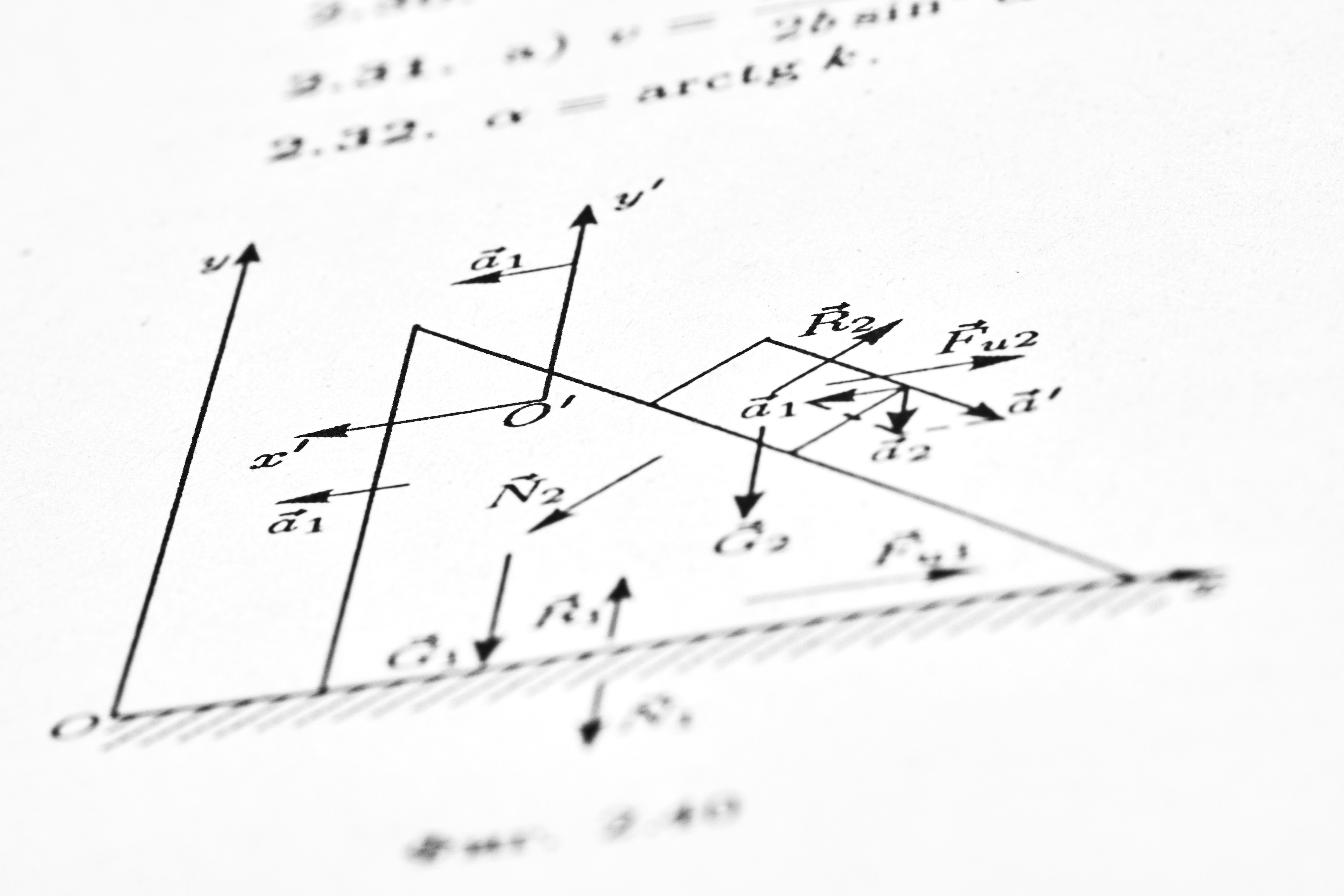

El crecimiento cuártico implica que las funciones están alejadas significativamente de sus mínimos, lo que complica la tarea de encontrar soluciones eficientes. Sin embargo, las adaptaciones al descenso del gradiente han llevado a la identificación de estrategias que permiten una convergencia casi lineal en entornos locales, lo que resulta prometedor para diversas aplicaciones. Un enfoque directo basado en el concepto de Lyapunov ofrece una nueva perspectiva sobre cómo abordar estos problemas, al permitir que las condiciones de convexidad y unicidad de los minimizadores sean satisfechas.

La adaptabilidad del algoritmo se traduce en un menor coste computacional y en una mejor experiencia para el usuario final. A medida que más empresas buscan implementar soluciones de inteligencia artificial para optimizar sus procesos, la necesidad de aplicar métodos de optimización eficientes cobra mayor relevancia. En este contexto, contar con soluciones de software a medida que integren estas metodologías permite a las organizaciones maximizar el rendimiento de sus operaciones y mejorar la toma de decisiones basada en datos.

En el ámbito de la tecnología empresarial, servicios como la inteligencia de negocio se ven beneficiados por estos avances. Herramientas como Power BI son esenciales para visualizar datos y facilitar la interpretación de resultados, lo que permite a las empresas actuar con agilidad. A través de algoritmos de descenso del gradiente mejorados, es posible refinar los modelos predictivos que sustentan estas herramientas, ofreciendo así una mayor fiabilidad y precisión.

Además, al integrar estos métodos en entornos de servicios cloud como AWS y Azure, se pueden escalonar las capacidades de procesamiento y almacenamiento, optimizando aún más los flujos de trabajo y el tiempo de respuesta. Las implicaciones son vastas, y aquellas empresas que decidan adoptar y adaptar estas metodologías para actuar de forma proactiva en sus estrategias tecnológicas estarán en una posición privilegiada.

En resumen, la investigación en torno a la convergencia casi lineal del descenso del gradiente no solo es un avance académico, sino que también tiene aplicaciones prácticas que impactan directamente en el desarrollo de software y en la competitividad empresarial en la era digital. Las empresas que aprovechen estos avances, a través de soluciones personalizadas, estarán mejor equipadas para enfrentar los desafíos del mundo moderno.

Comentarios