Explicaciones alineadas en redes neuronales

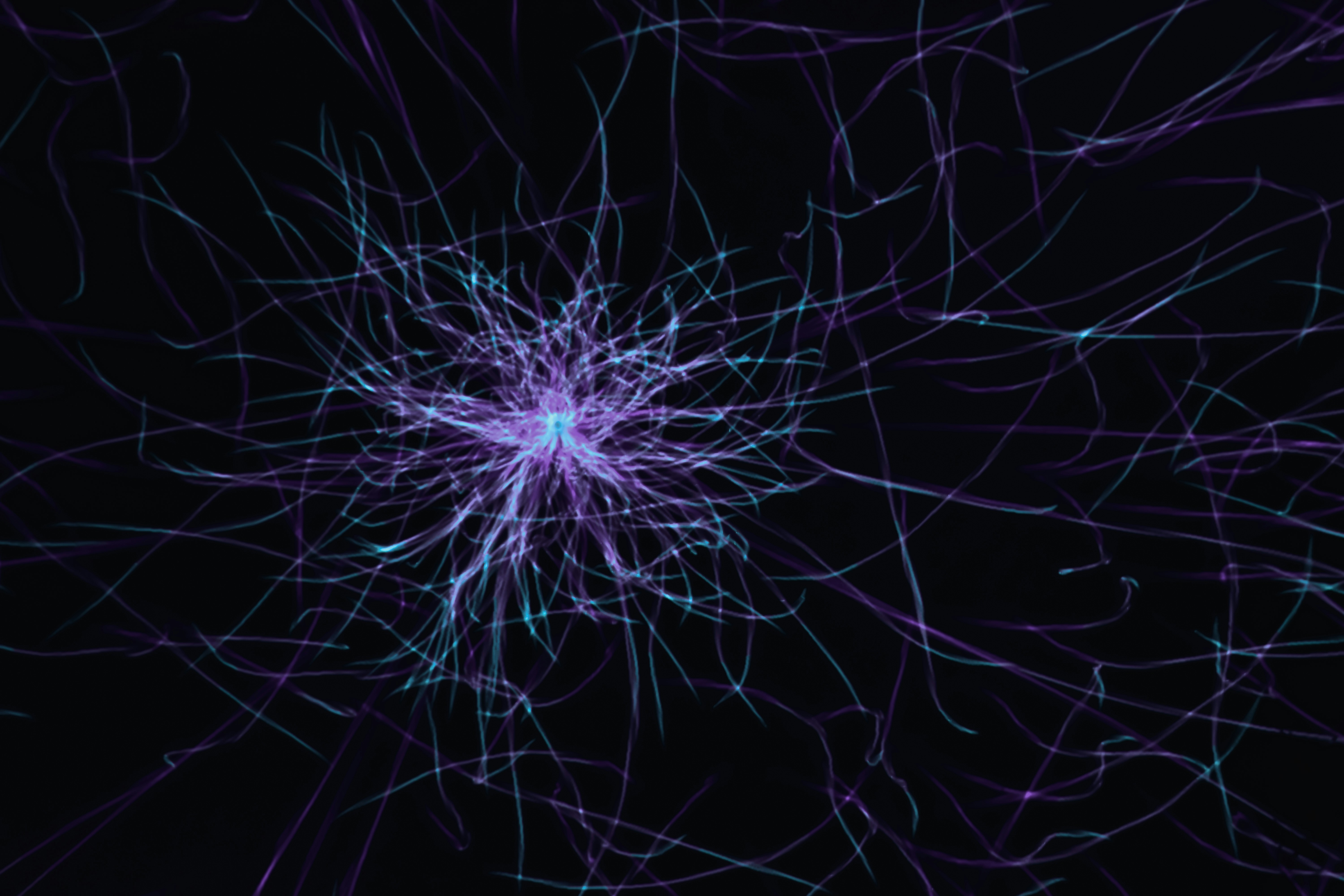

Las redes neuronales han revolucionado el campo de la inteligencia artificial, permitiendo resolver problemas complejos que antes parecían insuperables. Sin embargo, uno de los desafíos más significativos que enfrentamos cuando utilizamos estas tecnologías es la comprensión de cómo toman decisiones. La idea de alineación de explicaciones se presenta como un enfoque prometedor para abordar esta preocupación, asegurando que las justificaciones detrás de las predicciones de un modelo sean coherentes y transparentes.

El concepto de explicaciones alineadas sugiere que las razones por las cuales un modelo toma una decisión deben estar directamente relacionadas con los factores que influyen en dicha decisión. Esto fomenta la confianza en los modelos, permitiendo a los desarrolladores y a los usuarios entender verdaderamente el razonamiento detrás de las predicciones. Este nivel de transparencia es esencial, especialmente en aplicaciones críticas como la salud, donde la comprensibilidad de la IA puede ser la diferencia entre una decisión beneficiosa y una perjudicial.

En este contexto, las empresas tecnológicas como Q2BSTUDIO destacan por su capacidad de aportar soluciones innovadoras que integran estas ideas en el desarrollo de software a medida. Al implementar IA para empresas, es posible crear modelos que no solo sean precisos, sino que también ofrezcan explicaciones claras y alineadas con sus resultados. Por ejemplo, al desarrollar aplicaciones que utilizan redes neuronales, la implementación de principios de alineación de explicaciones puede ser crucial para aplicaciones en sectores como la ciberseguridad, donde las decisiones tomadas por un modelo pueden tener implicaciones significativas.

Además, la capacidad de proporcionar explicaciones claras ayuda a mitigar el riesgo en la adopción de tecnologías emergentes. A medida que las organizaciones integran soluciones de ciberseguridad apoyadas por IA, contar con una comprensión sólida de cómo operan estos sistemas puede fortalecer la confianza en su uso. Asimismo, en el ámbito de los servicios en la nube, como los que ofrece Q2BSTUDIO en plataformas como AWS y Azure, la habilidad de trazar decisiones de modelo puede maximizar la eficiencia operativa y mejorar el rendimiento general del negocio.

El desarrollo de modelos interpretables y alineados con sus predicciones no solo promueve la confianza, sino que también facilita la incorporación de tecnologías sofisticadas en la toma de decisiones empresariales. Esto es especialmente relevante al considerar el análisis de datos y la inteligencia de negocio. Herramientas como Power BI se benefician de esta interpretación, permitiendo a los usuarios realizar análisis más profundos y fundamentados, basados en modelos que son comprensibles y justificados.

En resumen, fomentar la alineación de explicaciones en redes neuronales no es solo cuestión de mejora técnica, sino una necesidad vital para establecer confianza en la inteligencia artificial. Las empresas que adopten este enfoque, como Q2BSTUDIO, están mejor posicionadas para ofrecer soluciones tecnológicas robustas y efectivas, ayudando a sus clientes a navegar el complejo paisaje de la inteligencia artificial y sus aplicaciones.

Comentarios