Identificación de Neuronas Buenas y Malas para LLMs Controlables a Nivel de Tarea

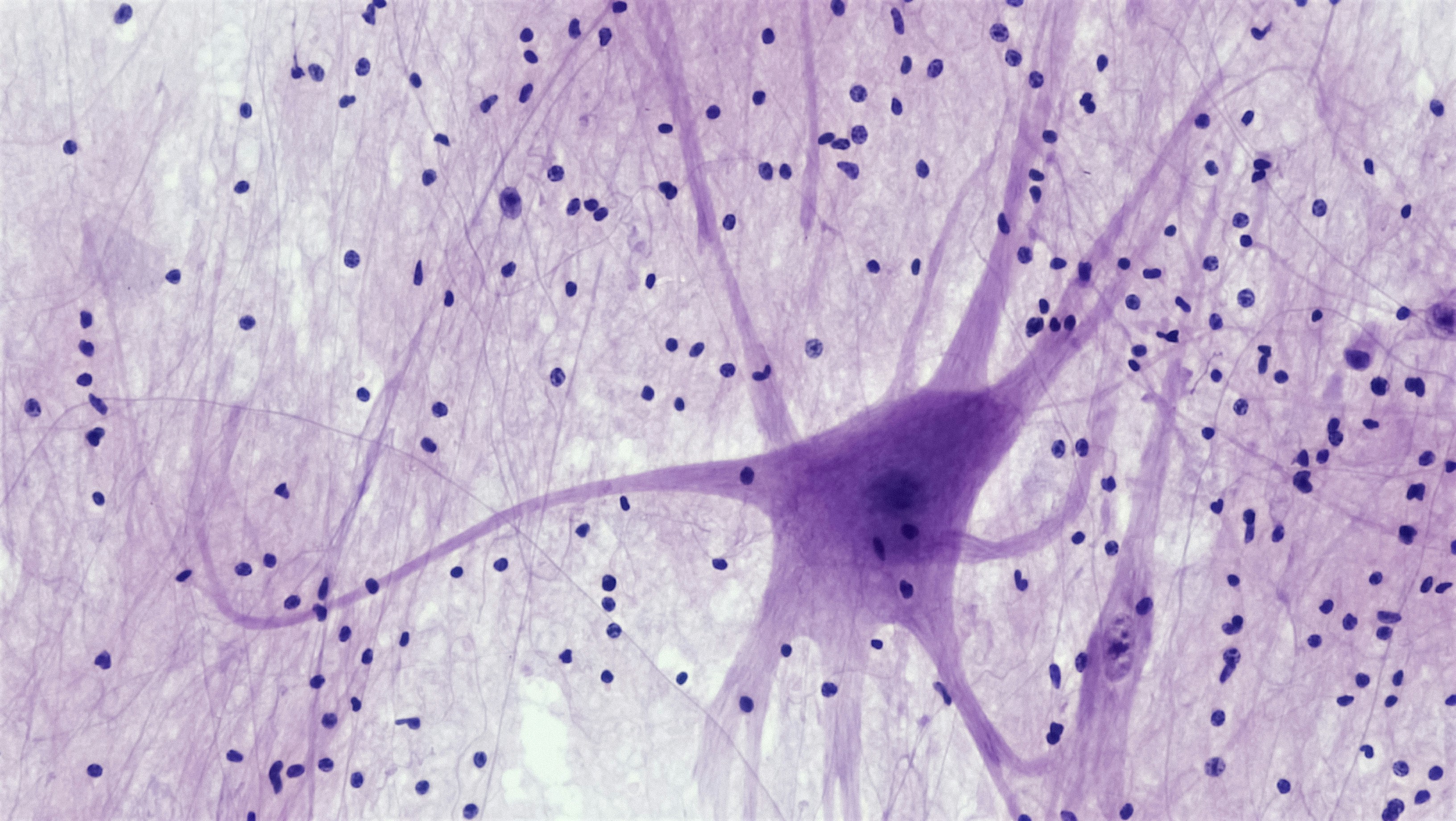

En el mundo actual de la inteligencia artificial, los modelos de lenguaje han demostrado ser herramientas poderosas para la generación y el análisis de texto. Sin embargo, comprender cómo operan internamente estos sistemas sigue siendo un reto significativo. La identificación de las 'neuronas buenas' y 'neuronas malas' dentro de estos modelos es crucial para optimizar su rendimiento en tareas específicas y minimizar comportamientos erróneos o aleatorios que pueden surgir durante su funcionamiento.

Una de las ideas más revolucionarias en este ámbito es la aplicación del concepto de antagonismo funcional. Este principio biológico sugiere que, al igual que en el cerebro humano, determinadas neuronas pueden tener efectos opuestos en el rendimiento de una tarea. Por un lado, están las neuronas que facilitan la realización de una actividad; por otro, aquellas que interfieren, y su interacción determina el éxito o fracaso en el procesamiento de información.

El modelo NeuronLLM propone una manera de identificar estas neuronas utilizando un enfoque de aprendizaje contrastivo, es decir, se busca no solo entender qué neuronas son eficaces, sino también aquellas que pueden ser perjudiciales para la tarea. Esta perspectiva integral permite a los desarrolladores y expertos en IA tener un panorama más amplio sobre cómo ajustar y entrenar estos modelos para mejorar su rendimiento en aplicaciones a medida.

Desde el punto de vista empresarial, las implicaciones de esta investigación son enormes. En Q2BSTUDIO, nos dedicamos al desarrollo de soluciones de inteligencia artificial para empresas, donde la adaptabilidad y el control sobre los modelos de lenguaje son fundamentales. Al integrar mecanismos que permiten identificar y ajustar estas neuronas, podemos ofrecer soluciones más efectivas y personalizadas, apoyando a nuestros clientes a maximizar sus inversiones en tecnología.

La combinación de enfoques como el aprendizaje contrastivo con una comprensión más profunda de la estructura interna de los LLMs abre nuevas vías para el desarrollo de servicios cloud en AWS y Azure. Estos entornos permiten escalar y demandar recursos computacionales de manera flexible, lo que resulta esencial para implementar tecnologías avanzadas de manera eficaz.

Finalmente, abordar la funcionalidad de las neuronas en LLMs no solo se traduce en una mejora técnica, sino que también brinda a las empresas la oportunidad de adoptar estrategias más sofisticadas en inteligencia de negocio, potenciando herramientas como Power BI para la visualización y análisis eficaz de datos. Con un mejor entendimiento del rendimiento de estos modelos, las organizaciones pueden tomar decisiones informadas que optimicen sus operaciones y estrategias en el mercado.

Comentarios