Neuronas en reposo, perspectivas activas: Robustecer la escasez de activación para grandes modelos de lenguaje

La inferencia de modelos de lenguaje de gran escala sigue siendo uno de los cuellos de botella más críticos para su despliegue en producción. La técnica conocida como escasez de activación promete acelerar este proceso al suprimir selectivamente ciertas activaciones ocultas durante el cómputo, pero su aplicación práctica tropieza con una pérdida severa de precisión cuando se busca un alto nivel de compresión. Este fenómeno no es accidental: responde a una inestabilidad fundamental en las representaciones internas que el modelo aprendió durante su entrenamiento. Cuando forzamos a la red a operar con menos activaciones, alteramos el delicado equilibrio entre las señales dependientes de la entrada que definen cada predicción, generando desplazamientos en el espacio latente que degradan la calidad de las respuestas.

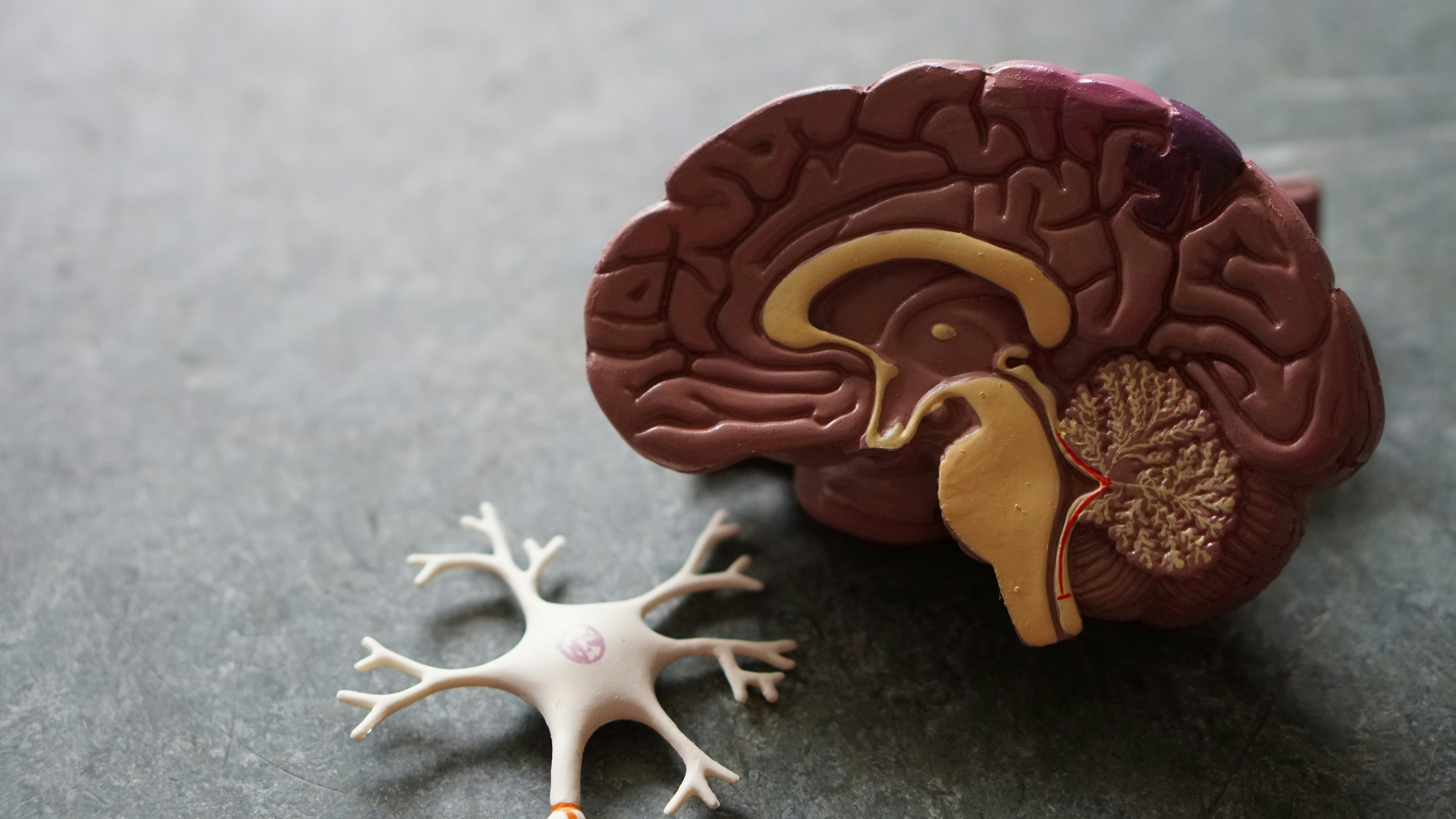

Para abordar este problema, la investigación reciente ha propuesto una perspectiva novedosa: en lugar de tratar la escasez como un simple recorte de parámetros, se replantea como un problema de alineación representacional. Inspirado en la actividad neuronal espontánea que ocurre en los sistemas biológicos incluso en ausencia de estímulos externos, surge un mecanismo ligero que inyecta un conjunto reducido de vectores de activación aprendidos, independientes de la entrada, que actúan como anclas persistentes para el cómputo disperso. Estos vectores se entrenan para igualar la distribución que generaría el modelo denso original y, tras el entrenamiento, pueden absorberse en los términos de sesgo sin añadir coste computacional adicional en inferencia. Los resultados muestran que esta aproximación restaura el rendimiento, estabiliza las representaciones latentes y preserva la capacidad de generalización, ofreciendo una ruta viable para una inferencia eficiente sin sacrificar calidad.

En el contexto empresarial, la aplicación de estas técnicas tiene implicaciones directas sobre el coste y la viabilidad de desplegar modelos de lenguaje en entornos reales. Una inferencia más rápida y precisa permite escalar asistentes conversacionales, sistemas de análisis documental o agentes IA que operan en tiempo real. Para lograr esa eficiencia, es clave contar con una infraestructura tecnológica que integre no solo el modelo optimizado, sino también el ecosistema de servicios cloud aws y azure que garantice elasticidad y disponibilidad. En Q2BSTUDIO combinamos nuestra experiencia en inteligencia artificial con el desarrollo de aplicaciones a medida que adaptan estos avances a las necesidades específicas de cada cliente. Nuestro equipo diseña soluciones de software a medida que incorporan desde la optimización de modelos hasta la capa de presentación, pasando por servicios inteligencia de negocio con power bi para visualizar el impacto de estas implementaciones.

La comprensión profunda de la dinámica interna de los modelos de lenguaje no solo mejora la inferencia, sino que también abre la puerta a nuevas arquitecturas más robustas. Por ejemplo, el uso de vectores de anclaje recuerda al funcionamiento de las redes de memoria a largo plazo, donde puntos de referencia estables evitan la deriva representacional. Este enfoque resulta especialmente relevante cuando se trabaja con dominios especializados como la ciberseguridad, donde la precisión en la detección de anomalías o en la generación de alertas es crítica. En Q2BSTUDIO desarrollamos soluciones que integran estas innovaciones con seguridad y escalabilidad, ofreciendo a las empresas la capacidad de implementar modelos de lenguaje de última generación sin comprometer la fiabilidad. Si desea explorar cómo esta tecnología puede transformar su negocio, le invitamos a conocer nuestros servicios de ia para empresas y agentes IA, donde combinamos investigación de frontera con implementación pragmática.

Comentarios