Uso de computadoras al borde del precipicio estadístico

La evaluación de agentes digitales diseñados para interactuar con interfaces gráficas se ha convertido en un campo de estudio tan prometedor como frágil. Cuando un simple script que reproduce secuencias de teclado sin observar la pantalla supera a modelos de inteligencia artificial de última generación en pruebas estándar, nos encontramos ante un claro síntoma de que la metodología empleada no es sólida. Este fenómeno, que podríamos denominar el precipicio estadístico del uso de computadoras, revela cómo la falta de entornos dinámicos y verificables puede llevar a conclusiones completamente equivocadas sobre la capacidad real de un agente.

Para sortear este abismo, es indispensable adoptar principios de diseño que garanticen que las pruebas reflejen condiciones realistas: entornos aislados, configuraciones con integridad verificada, variabilidad multifactorial y validación privilegiada. La comunidad técnica empieza a reconocer que no se trata de un refinamiento opcional, sino de un requisito previo para cualquier avance significativo. En este contexto, las empresas que desarrollan soluciones de aplicaciones a medida tienen la oportunidad de integrar estas buenas prácticas desde la fase de prototipado, evitando sesgos que luego se trasladan a producción.

La estadística, por su parte, debe aplicarse con rigor: la agregación ingenua de tasas de éxito o el uso incorrecto de métricas como pass@k en interacciones secuenciales generan intervalos de confianza que no reflejan la incertidumbre real. Metodologías como el bootstrap jerárquico combinado con intervalos de Wilson permiten capturar la estructura anidada de los benchmarks, ofreciendo una visión mucho más fiable del rendimiento. En Q2BSTUDIO, al desplegar ia para empresas, aplicamos estos mismos principios de evaluación rigurosa para garantizar que los agentes IA no solo funcionen en laboratorio, sino que se comporten de forma robusta ante la variabilidad del mundo real.

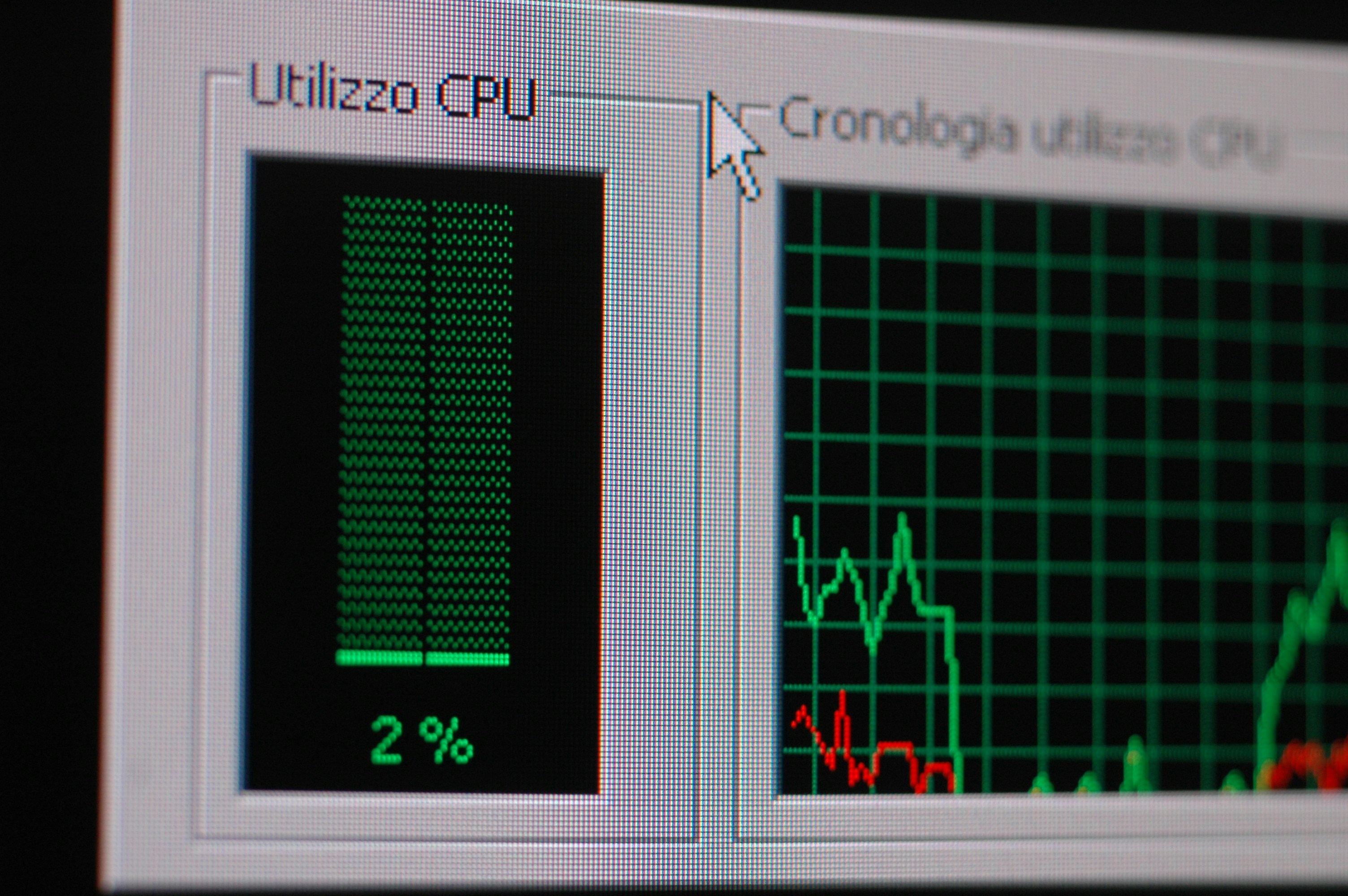

La inteligencia artificial aplicada a la interacción con ordenadores requiere además una infraestructura sólida. Los servicios cloud aws y azure proporcionan el aislamiento y la escalabilidad necesarios para ejecutar entornos de prueba con ciberseguridad integrada, evitando fugas de información o contaminación entre experimentos. La monitorización de estos agentes se beneficia directamente de servicios inteligencia de negocio como Power BI, que permiten visualizar métricas de rendimiento y detectar anomalías en tiempo real. La combinación de software a medida con estas capacidades cloud convierte a Q2BSTUDIO en un aliado natural para empresas que desean implementar agentes IA fiables y transparentes.

En definitiva, el precipicio estadístico no es un destino inevitable. Con entornos bien diseñados, metodologías de evaluación rigurosas y el soporte de tecnologías como la inteligencia artificial, la ciberseguridad y el cloud, es posible construir sistemas de uso computacional que realmente merezcan la confianza de sus usuarios. La clave está en no confundir una buena puntuación en un benchmark estático con un verdadero progreso hacia una inteligencia artificial autónoma y segura.

Comentarios