¿Son los LLMs revisores de código confiables? Sobre corrección sistemática en la evaluación de conformidad con los requisitos

En la actualidad, la integración de modelos de lenguaje grande (LLMs) en el ámbito del desarrollo de software ha generado un debate significativo sobre su fiabilidad como herramientas de revisión de código. Aunque estos modelos prometen optimizar los procesos de generación y validación de código, surgen interrogantes sobre su capacidad para cumplir con los requisitos establecidos en descripciones en lenguaje natural. Esta preocupación se magnifica al considerar que la mayoría de estos modelos se entrenan en vastos conjuntos de datos que pueden no reflejar con precisión las necesidades específicas de un proyecto.

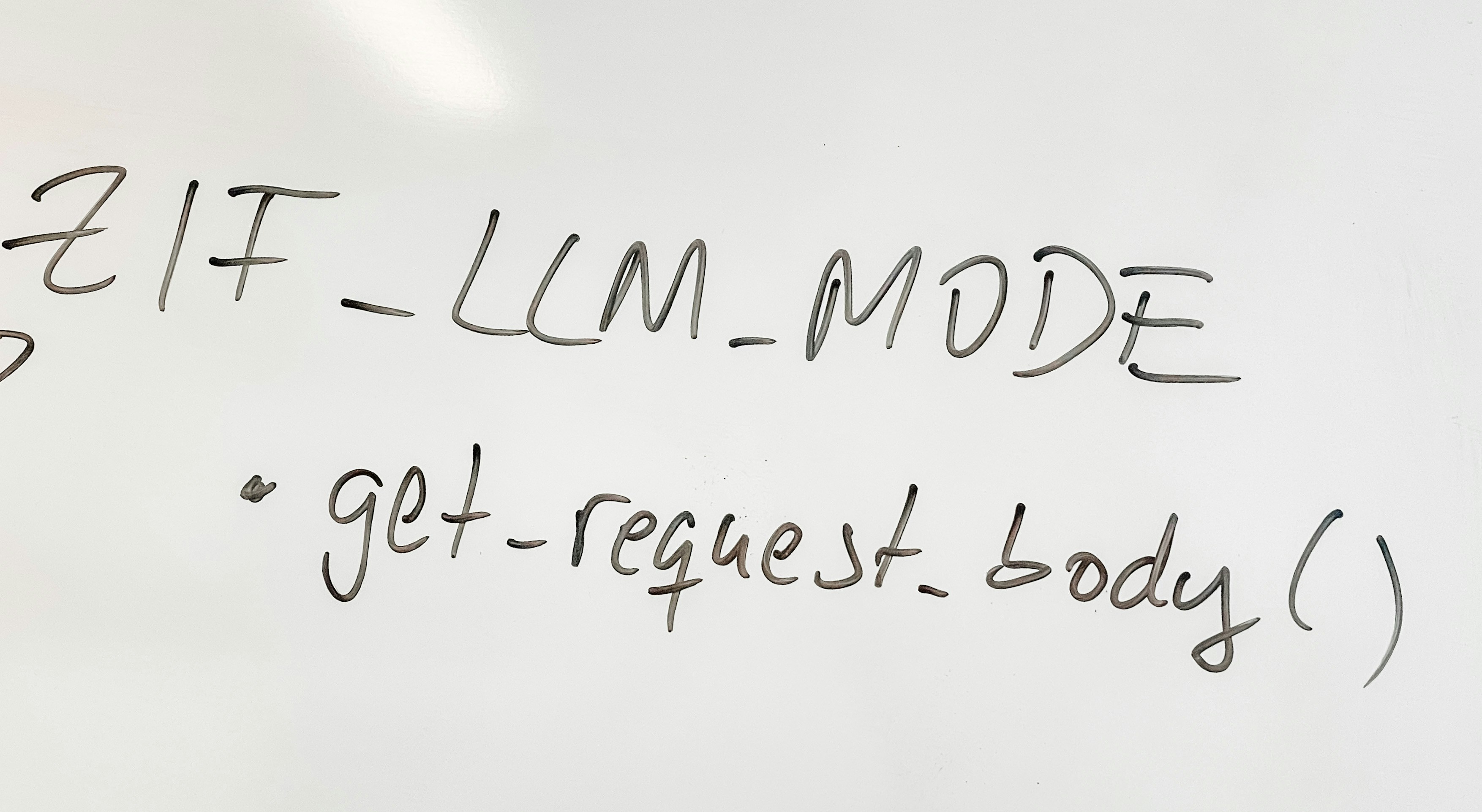

Uno de los aspectos a analizar es la forma en que los LLMs interpretan y traducen las especificaciones del usuario a implementaciones de código. Existen evidencias que sugieren que, en ocasiones, estos modelos pueden clasificar erróneamente implementaciones correctas como defectuosas o no conformes debido a malentendidos en el contexto o ambigüedades en los requisitos. Esta situación es alarmante, especialmente en entornos donde la precisión y la robustez del código son críticas, como en el desarrollo de aplicaciones a medida, donde cada funcionalidad debe alinearse perfectamente con las expectativas del cliente.

Además, se ha descubierto que al solicitar a los LLMs que proporcionen explicaciones y correcciones, sus tasas de fallo pueden incrementarse aún más, lo que revela limitaciones fundamentales en su capacidad para ofrecer evaluaciones adecuadas. Este fenómeno plantea la necesidad de establecer mecanismos que aseguren que estas herramientas sirvan de apoyo y no de obstáculo en el desarrollo. En este sentido, la integración de inteligencia artificial en los procesos de revisión de código debe ser Considerada con cuidado, adoptando enfoques que combinen la automatización con la supervisión humana para garantizar un producto final de alta calidad.

Desde Q2BSTUDIO, reconocemos la importancia de contar con revisores de código eficientes y confiables. Por ello, nuestras soluciones en inteligencia artificial están diseñadas para optimizar los flujos de trabajo sin sacrificar la calidad ni la seguridad. Implementamos sistemas que integran IA para empresas, mejorando la precisión en la detección de errores y el cumplimiento de estándares, además de fortalecer la ciberseguridad y la protección de datos sensibles en cada etapa del proceso de desarrollo.

En resumen, aunque los LLMs representan una herramienta valiosa en el campo del desarrollo de software, es crucial abordar sus limitaciones antes de considerarlos como una solución definitiva. La alianza entre inteligencia artificial y supervisión humana puede ser el camino hacia un futuro donde el desarrollo de software no solo sea más eficiente, sino también más alineado con los requerimientos de cada proyecto.

Comentarios