Memorizar teoremas, no instancias: Sondeo de la generalización de SFT mediante el razonamiento matemático

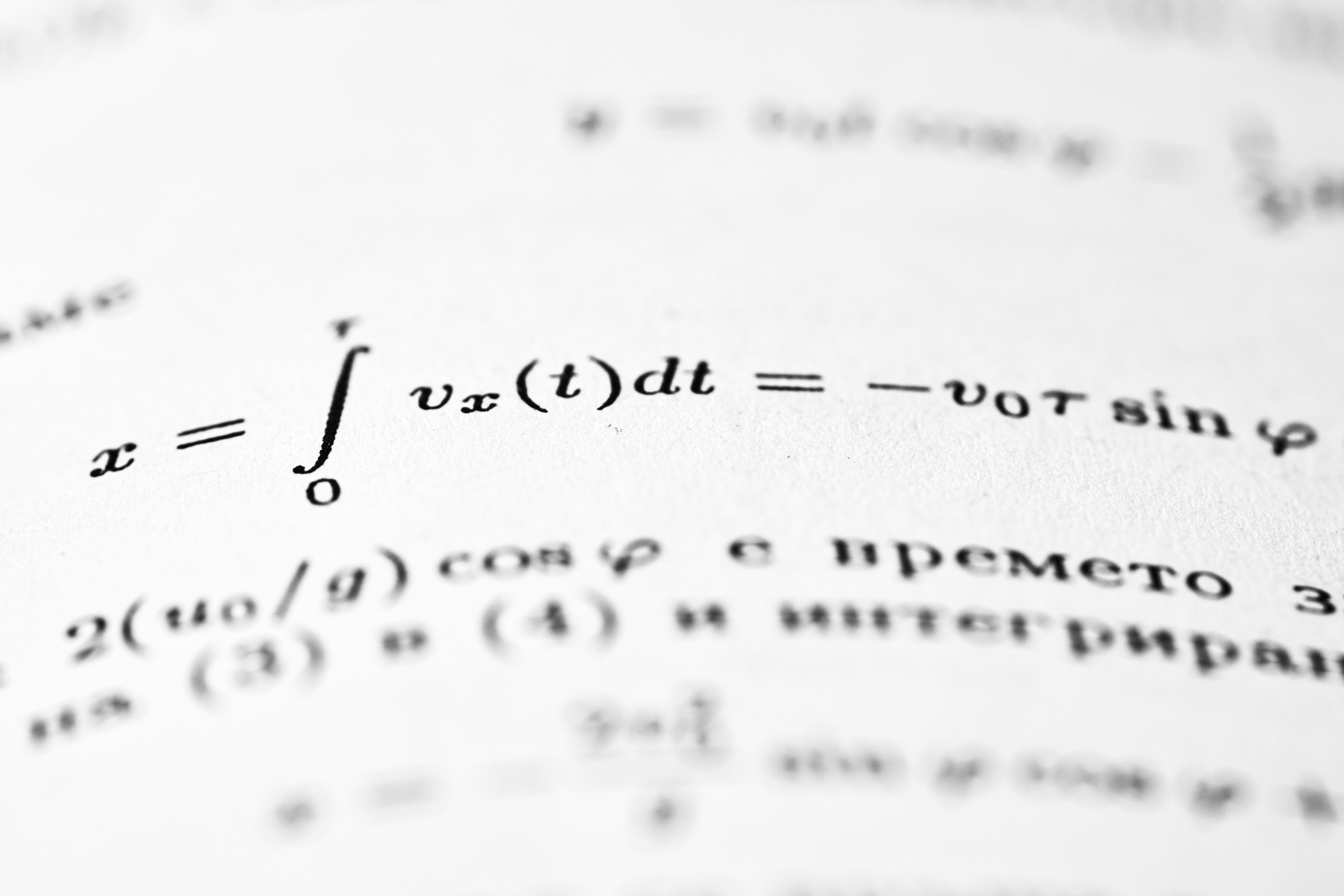

La supervisión fina supervisada (SFT) es una técnica habitual para adaptar modelos de lenguaje a tareas concretas, pero investigaciones recientes señalan que puede fomentar la memorización de correlaciones superficiales en lugar de un razonamiento genuino. El problema no reside en memorizar en sí, sino en qué se memoriza: cuando un modelo aprende a asociar patrones de entrada con respuestas sin comprender las reglas subyacentes, su capacidad de generalización se resiente ante variaciones mínimas. Un enfoque más sólido consiste en enseñar la aplicación de principios o teoremas, de modo que el modelo interiorice las reglas de inferencia y no ejemplos concretos. Esta filosofía es especialmente relevante en entornos empresariales donde se requieren soluciones robustas y adaptables. En Q2BSTUDIO, somos conscientes de estos desafíos y por ello desarrollamos aplicaciones a medida que integran inteligencia artificial de forma reflexiva, evitando sesgos de sobreadaptación. Nuestro equipo implementa ia para empresas basada en principios de razonamiento, lo que permite construir agentes IA capaces de operar con reglas claras en lugar de depender únicamente de datos históricos. Además, en el ámbito de la ciberseguridad y los servicios cloud aws y azure, aplicamos esta lógica para garantizar que los modelos se comporten de manera predecible y segura. Herramientas como power bi y otras soluciones de inteligencia de negocio se benefician de este enfoque al generar informes basados en inferencias consistentes. La clave está en memorizar teoremas, no instancias, y en Q2BSTUDIO lo llevamos a la práctica con software a medida que potencia el rendimiento sin sacrificar la generalización.

Comentarios