Cotas de error convexo-geométricas para cuadratura de kernel con pesos positivos

La integración numérica de funciones suaves es un desafío central en campos como la inteligencia artificial y el aprendizaje automático, donde los métodos basados en kernels permiten capturar estructuras complejas en espacios de Hilbert de reproducción. Sin embargo, los enfoques clásicos de cuadratura de kernel suelen requerir pesos con signo, lo que introduce inestabilidad numérica y limita su aplicación en entornos de producción. Una línea de investigación reciente demuestra que es posible mantener la aceleración espectral —es decir, tasas de error superiores al muestreo aleatorio— incluso cuando se fuerza a que los pesos sean estrictamente positivos, formando una combinación convexa de las muestras. Este resultado, que a primera vista parece una curiosidad matemática, tiene implicaciones profundas para el desarrollo de aplicaciones a medida que requieran alta precisión en integración de datos.

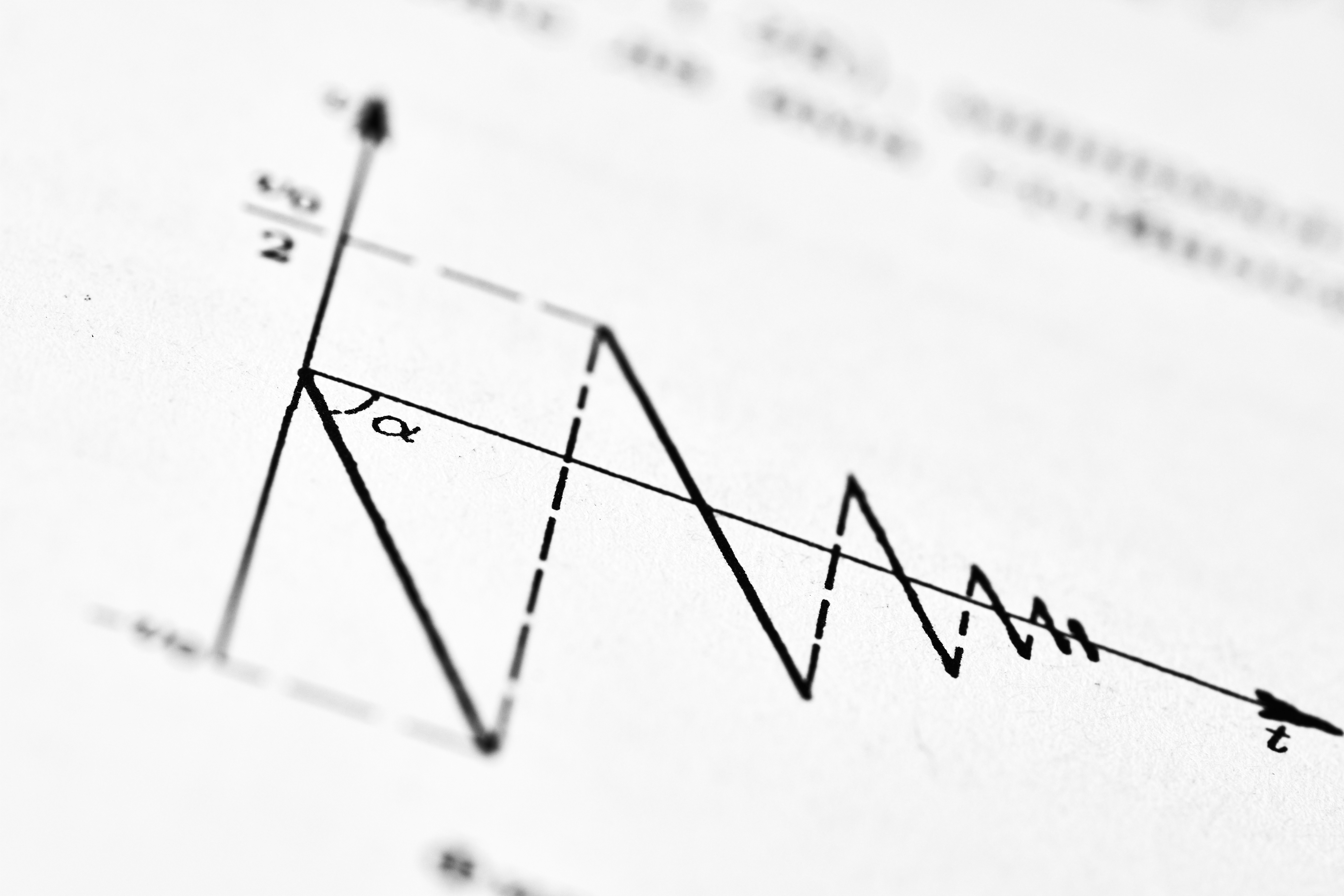

Desde un punto de vista geométrico, el problema se reduce a aproximar la media de un vector aleatorio en un espacio de dimensión d mediante el casco convexo de N muestras independientes. Sorprendentemente, se ha demostrado que esta aproximación logra un error del orden O(d/N) con alta probabilidad, superando a la media empírica en regímenes donde d es fijo. En el contexto de cuadratura de kernel, esta cota se traslada al error de integración en el espacio de Hilbert mediante un argumento de truncamiento de Mercer, dando lugar a cotas de error que, bajo decaimiento espectral exponencial, alcanzan tasas cercanas a O(1/N) salvo factores logarítmicos. Este avance teórico no solo es relevante para la estadística matemática, sino que abre la puerta a implementaciones algorítmicas robustas, como el método de Frank-Wolfe que opera directamente sobre las muestras y mantiene la restricción de positividad.

Para una empresa que desarrolla ia para empresas, entender estas cotas geométricas es crucial cuando se diseñan sistemas que deben funcionar con volúmenes de datos finitos y garantías de convergencia. La capacidad de reemplazar la integración Monte Carlo por esquemas de pesos positivos más estables permite reducir la varianza en simulaciones numéricas, mejorar la eficiencia de agentes IA que operan en entornos de alta dimensionalidad y ofrecer servicios inteligencia de negocio más precisos. En Q2BSTUDIO, integramos estos principios en nuestras soluciones de software a medida, combinando teoría de kernels con optimización convexa para crear productos que se adaptan a las necesidades específicas de cada cliente.

Además, la naturaleza constructiva de algoritmos como Frank-Wolfe facilita su despliegue en plataformas cloud, donde los servicios cloud aws y azure proporcionan la escalabilidad necesaria para procesar grandes pools de candidatos. La ciberseguridad también se beneficia de estas técnicas: al utilizar pesos positivos, se evitan oscilaciones numéricas que podrían ser explotadas en ataques adversariales. En paralelo, herramientas como power bi pueden consumir estos resultados de integración para generar dashboards que reflejen estimaciones robustas de incertidumbre. La sinergia entre matemática aplicada e ingeniería de software permite a Q2BSTUDIO ofrecer soluciones que van desde la automatización de procesos hasta la implementación de agentes IA especializados, siempre con un enfoque en la precisión y la estabilidad computacional.

En resumen, las cotas de error convexo-geométricas para cuadratura de kernel con pesos positivos representan un puente entre la teoría abstracta y la práctica industrial. Su comprensión permite desarrollar sistemas más fiables y eficientes, y su implementación en aplicaciones a medida es una de las áreas donde Q2BSTUDIO aporta valor diferencial. Al adoptar estos métodos, las empresas pueden reducir costes computacionales, mejorar la calidad de sus modelos y mantenerse a la vanguardia en un mercado donde la inteligencia artificial y la optimización numérica son cada vez más determinantes.

Comentarios