Por qué las matemáticas son esenciales en el aprendizaje automático

Introducción — El mito de la caja negra El aprendizaje automático suele presentarse como una disciplina puramente algorítmica: cargas datos, seleccionas un modelo, lo entrenas y funciona. Esta visión es parcialmente cierta pero incompleta. Detrás de cada algoritmo de aprendizaje automático existen estructuras matemáticas precisas: nociones de distancia, propiedades de continuidad, supuestos de convexidad, garantías de convergencia y límites teóricos que ningún modelo puede eludir. El aprendizaje automático moderno no sustituye a las matemáticas: es su aplicación directa.

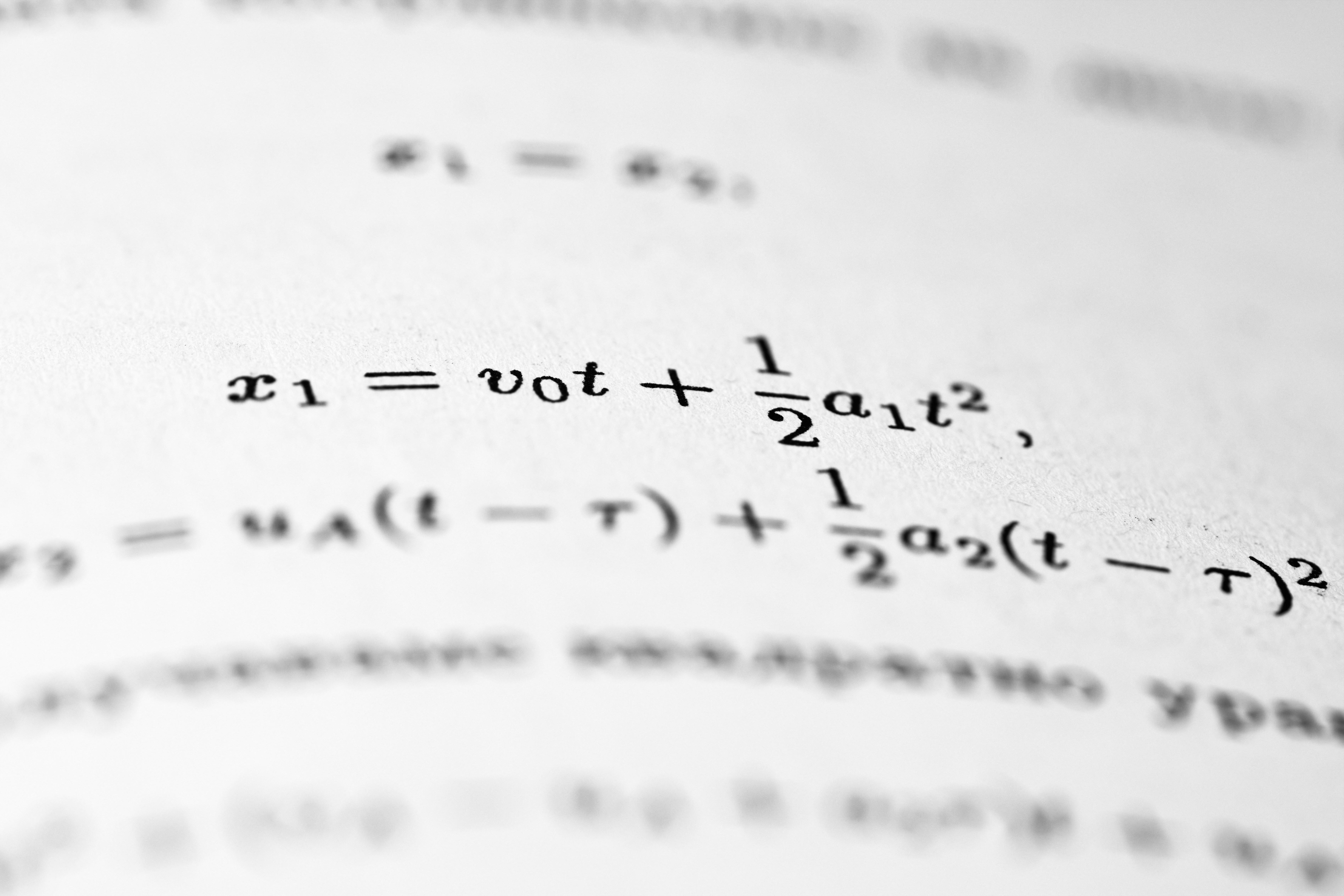

1. El aprendizaje automático es, sobre todo, un problema de optimización En esencia casi todos los algoritmos de ML buscan minimizar una función de pérdida. Esto plantea preguntas matemáticas fundamentales: qué significa minimizar, existe un mínimo, es único, puede alcanzarse numéricamente y a qué velocidad. Estas cuestiones no son puramente algorítmicas sino analíticas y requieren fundamentos matemáticos para ser resueltas.

2. Distancia, normas y geometría Antes de optimizar hay que decidir cómo medir el error. Esa elección introduce conceptos de distancia y norma. Ejemplos clásicos: MAE equivale a norma L1, MSE a norma L2, error máximo a norma L infinito. La norma elegida modifica la geometría del problema, afecta la robustez a valores atípicos, la estabilidad numérica y el comportamiento de métodos como el descenso por gradiente. Sin entender la geometría inducida por una norma no se comprende realmente qué está optimizando el algoritmo.

3. Convergencia Los algoritmos suelen ser iterativos y ello plantea la pregunta de si las sucesiones convergen y hacia qué. Conceptos de análisis como sucesiones y límites, sucesiones de Cauchy, completitud y continuidad son imprescindibles para explicar por qué a veces el entrenamiento diverge, oscila, es lento o por qué dos implementaciones dan resultados distintos.

4. Continuidad, condiciones Lipschitz y estabilidad Un modelo debe ser estable: pequeños cambios en los datos o en los parámetros no deben provocar predicciones erráticas. Esto se formaliza con continuidad uniforme y condiciones Lipschitz. La constante de Lipschitz controla velocidad y estabilidad del aprendizaje y no es un detalle teórico: influye en la elección de la tasa de aprendizaje y en las garantías de convergencia.

5. Convexidad La convexidad es una propiedad clave en optimización. Una función convexa tiene mínimo global único y no presenta trampas en forma de mínimos locales, lo que facilita garantías teóricas en problemas como la regresión lineal o máquinas de soporte vectorial. Las redes neuronales profundas son no convexas pero funcionan gracias a estructuras particulares y heurísticas eficaces. Conocer cuándo existen garantías y cuándo no lo hacen es fundamental para diseñar soluciones robustas.

6. Teoría frente a práctica Las matemáticas garantizan propiedades, no milagros. Pueden decir si existe una solución, si es única, si un algoritmo converge y a qué ritmo. No pueden garantizar datos buenos, generalización correcta ni ausencia de sesgos. Actuar sin teoría equivale a avanzar a ciegas y con riesgo de errores costosos.

Aplicaciones y servicios con base matemática en Q2BSTUDIO En Q2BSTUDIO aplicamos estos fundamentos matemáticos para crear soluciones reales y seguras. Como empresa de desarrollo de software y aplicaciones a medida diseñamos productos que integran inteligencia artificial aplicada, agentes IA y soluciones de ia para empresas con criterios de estabilidad y explicabilidad. Si necesita desarrollar una plataforma o una app podemos ayudarle con software a medida y aplicaciones a medida adaptadas a sus requisitos.

Además ofrecemos servicios de ciberseguridad y pentesting para proteger modelos y datos, así como despliegue en la nube con servicios cloud aws y azure para escalar soluciones de forma segura. También desarrollamos servicios de inteligencia de negocio y paneles con power bi para transformar datos en decisiones operativas. Nuestra experiencia combina teoría matemática, ingeniería de software y operaciones de seguridad para lograr implementaciones robustas y escalables.

Conclusión — Entender antes de optimizar El aprendizaje automático se sostiene sobre tres pilares matemáticos: geometría de espacios y normas, análisis con continuidad y convergencia, y teoría de optimización con convexidad y métodos numéricos. Ignorar estas bases lleva a aplicar recetas sin comprender sus límites, a diagnosticar mal fallos y a sobrecomplicar soluciones simples. Comprender el análisis matemático del aprendizaje automático no es teoría por la teoría: es control, robustez e intuición para construir productos de calidad.

Contacte con nosotros Si busca integrar inteligencia artificial en su empresa o necesita asesoría en aplicaciones a medida, ciberseguridad, servicios cloud aws y azure, o inteligencia de negocio con power bi, en Q2BSTUDIO ofrecemos consultoría y desarrollo especializado. Conozca nuestras soluciones de Inteligencia Artificial y cómo las implementamos en entornos reales para obtener resultados medibles servicios de inteligencia artificial.

Comentarios