AI Powerhouses: Cómo aprovechar las redes neuronales conjuntas en aplicaciones multimodales

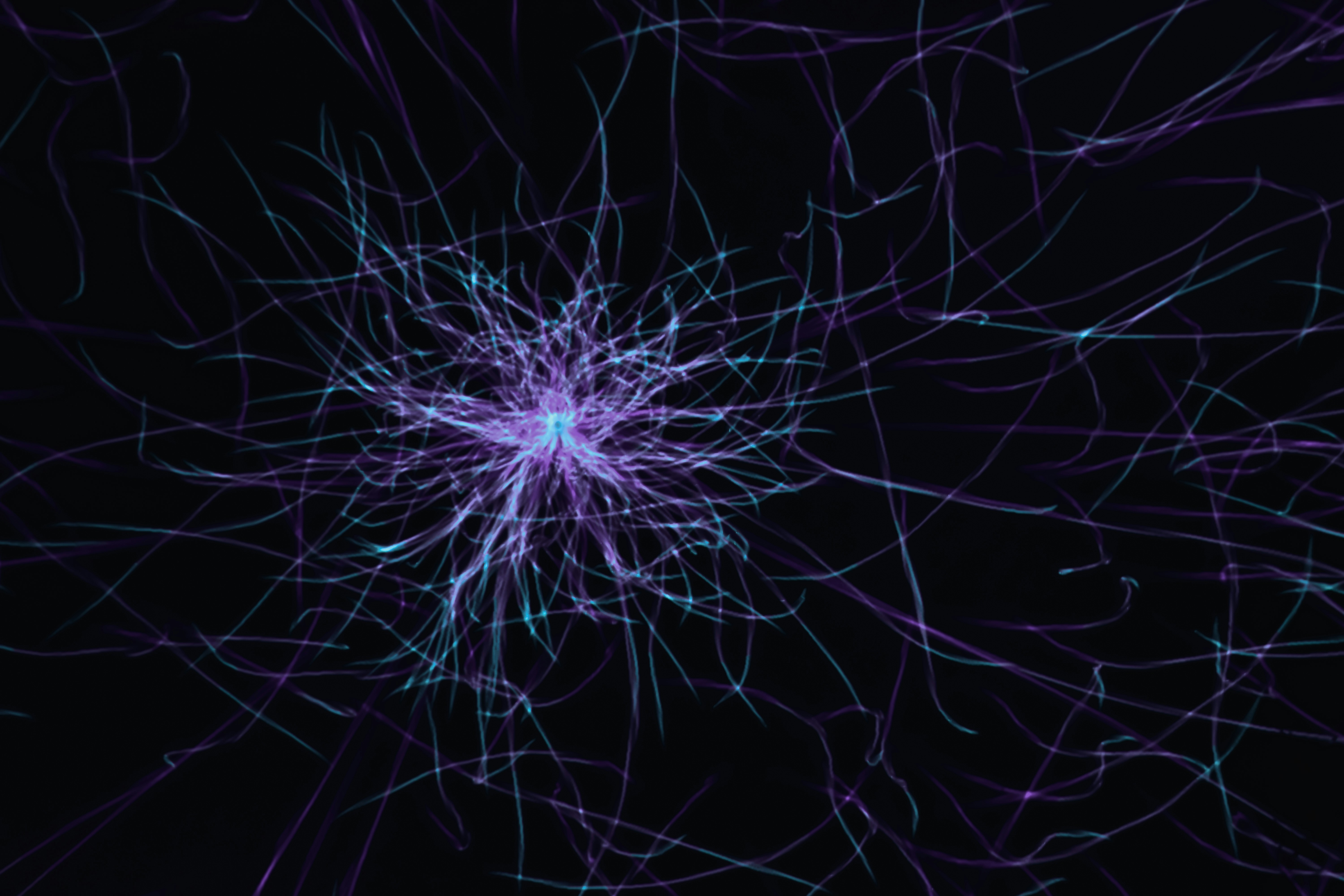

La inteligencia artificial multimodal es un campo en rápida evolución que integra visión por computador, procesamiento del lenguaje natural y análisis de audio para lograr interacciones humano-máquina más naturales y efectivas.

Concepto y funcionamiento: La IA multimodal procesa simultáneamente diferentes tipos de datos como texto, imágenes y audio para comprender contextos complejos y tomar decisiones informadas. Este enfoque está inspirado en la percepción humana, donde varios sentidos se combinan para interpretar la realidad.

Tipos de datos multimodales: texto procesado con técnicas de NLP, imágenes analizadas con modelos de visión por computador y señales de audio procesadas para reconocer voz y emociones.

Aplicaciones prácticas: asistentes virtuales que comprenden voz y contexto visual, chatbots capaces de interpretar emoción y contenido multimedia, vehículos autónomos que fusionan cámaras, lidar y radar en tiempo real, y soluciones empresariales que combinan documentos, dashboards y audio para automatizar workflows.

Desafíos clave: alineación de datos entre modalidades para sincronizar diálogo con expresiones faciales o sensores; demanda computacional elevada para afinamiento multimodal a escala; y amplificación de sesgos cuando entradas parciales se combinan entre modalidades.

Tendencias a vigilar: ventanas de contexto extendidas que permiten razonamiento más profundo sobre grandes volúmenes de contenido multimodal; y streaming bidireccional para comunicación en tiempo real donde humano y agente IA hablan, escuchan y responden de forma simultánea.

Implementación y buenas prácticas: elegir arquitecturas eficientes que escalen con grandes volúmenes de datos; aplicar técnicas de alineación temporal y semántica entre modalidades; monitorizar recursos computacionales y diseñar pipelines que permitan inferencia incremental y optimizada.

Ejemplo conceptual de integración: procesar texto con un módulo NLP, extraer características visuales con un encoder de imágenes, obtener vectores de audio con un extractor de espectrogramas y fusionar las representaciones para alimentar una capa de decisión que combine predicciones por votación ponderada.

Q2BSTUDIO y la IA multimodal: En Q2BSTUDIO somos una empresa de desarrollo de software y soluciones a medida que acompaña a las organizaciones en la adopción de inteligencia artificial para empresas. Ofrecemos servicios de desarrollo de aplicaciones a medida y plataformas escalables, así como proyectos de inteligencia artificial que integran agentes IA, visión por computador, NLP y pipelines de audio.

Nuestra oferta integral incluye además ciberseguridad y pentesting para proteger modelos y datos sensibles, servicios cloud aws y azure para desplegar infraestructuras robustas, y servicios de inteligencia de negocio y power bi para convertir datos multimodales en decisiones accionables.

Palabras clave de valor para su proyecto: aplicaciones a medida, software a medida, inteligencia artificial, ciberseguridad, servicios cloud aws y azure, servicios inteligencia de negocio, ia para empresas, agentes IA, power bi. Estas capacidades permiten a Q2BSTUDIO diseñar soluciones que aumentan la eficiencia operativa y la experiencia de usuario.

Conclusión: La IA multimodal transforma la forma en que las máquinas perciben y responden al mundo. Su implementación requiere visión técnica, recursos computacionales y marcos éticos claros. Como partner tecnológico, Q2BSTUDIO combina experiencia en desarrollo de software, IA, ciberseguridad y cloud para que las empresas puedan aprovechar todo el potencial de los modelos multimodales y escalar con seguridad y eficacia.

Comentarios