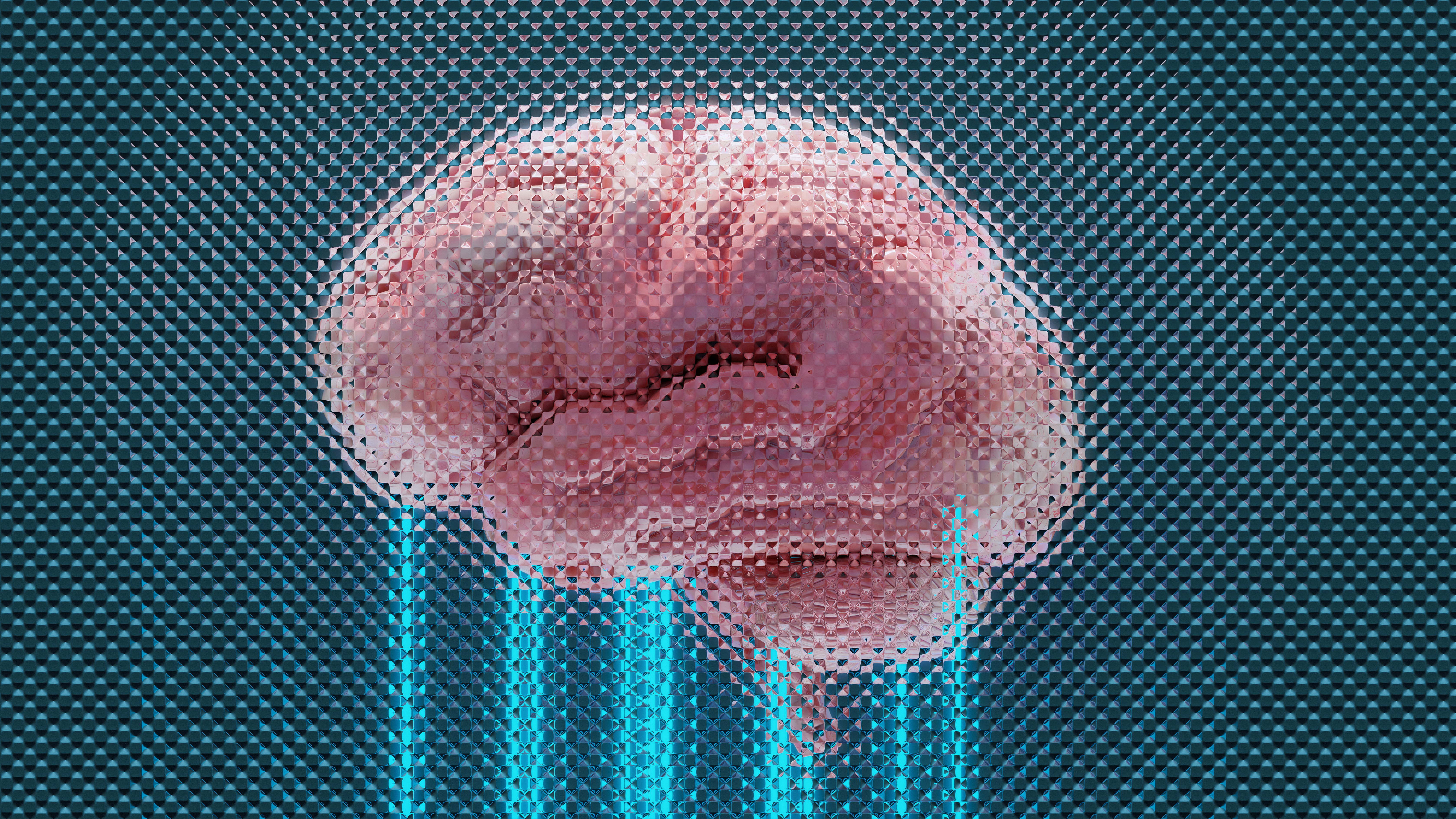

La memorización en Stable Diffusion es impulsada inesperadamente por los embeddings de CLIP

Los modelos generativos de imagen basados en difusión han revolucionado la creación visual automatizada, pero también han revelado vulnerabilidades inesperadas en su arquitectura interna. Un fenómeno particularmente relevante es la memorización: la capacidad del modelo de reproducir fragmentos casi idénticos de sus datos de entrenamiento, lo que plantea riesgos de privacidad y originalidad. Investigaciones recientes han identificado que los embeddings generados por CLIP, el sistema de codificación textual que guía la generación, contienen un comportamiento singular que exacerba este problema. Ciertos tokens de relleno o estructurales, diseñados originalmente para homogeneizar secuencias de entrada, terminan amplificando el peso de un único embedding optimizado durante el entrenamiento del codificador. Esta redundancia no intencionada provoca que el modelo se apoye desproporcionadamente en esa señal, desencadenando la memorización sin que medie una instrucción explícita del usuario.

Para las empresas que integran inteligencia artificial en sus flujos de trabajo, comprender estos mecanismos no es solo una curiosidad académica. El uso de modelos generativos en entornos productivos exige garantías de originalidad y control sobre los resultados. Desde Q2BSTUDIO, como empresa de desarrollo de software y tecnología, abordamos estos desafíos diseñando ia para empresas que incorporan estrategias de mitigación, como la manipulación controlada de los embeddings de entrada o la sustitución de tokens problemáticos antes de la inferencia. Estas intervenciones, alineadas con los hallazgos técnicos más recientes, permiten reducir la memorización sin sacrificar calidad visual, y son especialmente útiles en aplicaciones a medida donde la originalidad y la seguridad son críticas.

El problema de la memorización no es aislado: afecta a la ciberseguridad de los sistemas generativos, ya que un modelo que reproduce datos sensibles puede exponer información confidencial de las bases de entrenamiento. Por eso, en proyectos que combinan software a medida con modelos de difusión, recomendamos integrar capas de protección desde el diseño. Por ejemplo, implementar servicios cloud aws y azure para escalar las cargas de inferencia permite aplicar filtros de embeddings de forma eficiente sin degradar el rendimiento. Asimismo, las soluciones de servicios inteligencia de negocio y power bi pueden monitorizar la aparición de patrones memorizados en lotes de imágenes generadas, facilitando la auditoría continua.

Otra vía prometedora es el uso de agentes IA que, en tiempo de generación, evalúan la influencia relativa de cada token y ajustan dinámicamente el peso de los embeddings problemáticos. En Q2BSTUDIO desarrollamos este tipo de agentes como parte de nuestras plataformas de inteligencia artificial, permitiendo que los clientes desplieguen modelos generativos más fiables y éticos. La clave está en entender que la memorización no es un fallo inevitable, sino una consecuencia de cómo se estructuran los embeddings; con intervenciones quirúrgicas a nivel de token, es posible redirigir el comportamiento del modelo hacia una síntesis verdaderamente original.

En definitiva, la investigación sobre los desencadenantes de la memorización en Stable Diffusion subraya la necesidad de un enfoque integral que combine ciencia de datos, seguridad y personalización. Las empresas que deseen adoptar generación de imágenes con IA deben contemplar tanto la calidad del resultado como la integridad del proceso. En ese camino, contar con socios tecnológicos que ofrezcan soluciones de software a medida y conocimiento profundo de la infraestructura cloud resulta determinante para convertir la inteligencia artificial en una herramienta verdaderamente segura y productiva.

Comentarios