Cómo funcionan realmente los Modelos de Lenguaje Grandes (LLMs)

En esta nueva entrega sobre inteligencia artificial explico de forma clara cómo funcionan realmente los Modelos de Lenguaje Grandes LLMs y por qué no piensan como nosotros. Aunque pueden escribir textos sorprendentes, su creatividad responde a patrones estadísticos y no a una comprensión semántica profunda.

La inteligencia humana es semántica: interpretamos, conectamos experiencias, emociones y significados. Cuando creamos, unimos recuerdos y asociaciones para generar ideas originales mediante razonamiento reflexivo y deliberado. En cambio los LLMs son sintácticos: manipulan forma y predicen cuál es la siguiente unidad de texto probable a partir de enormes cantidades de datos entrenados. Esa diferencia entre sentido y mimetismo es clave para sacarles el máximo partido.

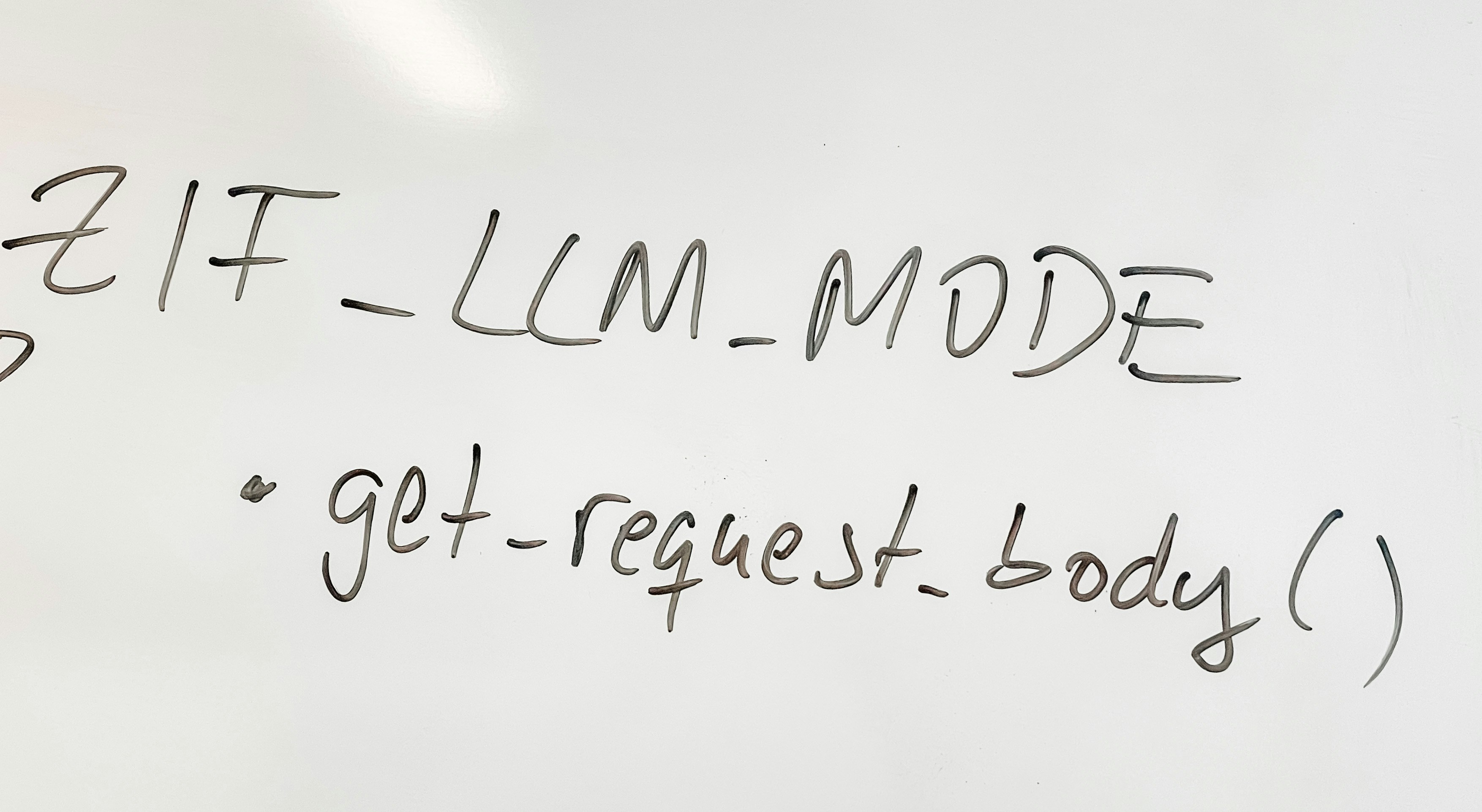

En el corazón de estos sistemas están los tokens pequeñas unidades que representan palabras, partes de palabras o signos de puntuación. El modelo calcula la probabilidad de cada token siguiente y así construye frases y párrafos. Cada LLM dispone además de una ventana de contexto que actúa como memoria a corto plazo. Cuando esta ventana se llena la información anterior se comprime o se pierde y el modelo deja de 'ver' lo que ocurrió antes por eso a veces contradice detalles o pierde condiciones de instrucciones complejas.

Los límites de tokens han cambiado mucho con el tiempo. Versiones anteriores manejaban miles de tokens, mientras modelos más recientes amplían ese contexto a cientos de miles o incluso a casi un millon de tokens permitiendo conversaciones largas y carga de documentos extensos. Aun así esto no sustituye a la memoria humana: la capacidad de recordar, reflexionar y mantener coherencia a lo largo del tiempo sigue siendo dominio humano.

Cuando trabajas con textos largos el modelo fragmenta la información en trozos o chunks que caben en la ventana de contexto. Para superar los límites aparece la técnica RAG Retrieval Augmented Generation que permite recuperar fragmentos relevantes desde una base de datos o documentos externos y presentárselos al modelo para generar respuestas más ajustadas y fundamentadas. RAG y el chunking funcionan mejor si tus documentos están bien estructurados con secciones claras y resúmenes sencillos.

Al diseñar prompts recuerda mantener instrucciones concretas y reintroducir el contexto cuando sea necesario. Piensa en el modelo como alguien que apunta mientras hablas: si quieres consistencia repite los datos clave y estructura la información en bloques manejables. De esta forma reduces errores en instrucciones con negaciones o condiciones complejas y mejoras la coherencia del resultado.

En Q2BSTUDIO somos especialistas en transformar estas capacidades en soluciones reales. Desarrollamos aplicaciones a medida y software a medida que incorporan agentes IA, integración con modelos de lenguaje y pipelines RAG para ofrecer respuestas fundamentadas y escalables. Además ofrecemos servicios de inteligencia artificial pensados para empresas, desde prototipos hasta despliegues en producción.

Nuestro equipo combina experiencia en inteligencia artificial, ciberseguridad, servicios cloud aws y azure y servicios inteligencia de negocio para asegurar que tus proyectos sean robustos y cumplan normativas. Implementamos soluciones de IA para empresas con agentes IA, integraciones con Power BI y automatizaciones que aceleran procesos y mejoran la toma de decisiones.

Si necesitas proteger tus sistemas también proporcionamos auditorías y pruebas de pentesting que garantizan la seguridad de tus aplicaciones y datos. Y si buscas explotar datos para obtener ventajas competitivas ofrecemos soluciones de inteligencia artificial y servicios Business Intelligence que aprovechan Power BI para visualizar y emponderar decisiones basadas en datos.

En resumen los LLMs extienden nuestra creatividad pero no la reemplazan. Comprender tokens, ventana de contexto, chunking y RAG te permite usarlos con más confianza y diseñar soluciones tecnológicas seguras y eficaces. En Q2BSTUDIO convertimos ese conocimiento en productos tangibles: software a medida, soluciones IA para empresas, ciberseguridad, servicios cloud aws y azure y proyectos de inteligencia de negocio que impulsan resultados reales.

Comentarios