Modulación neuronal dirigida mediante búsqueda de pares contrastivos

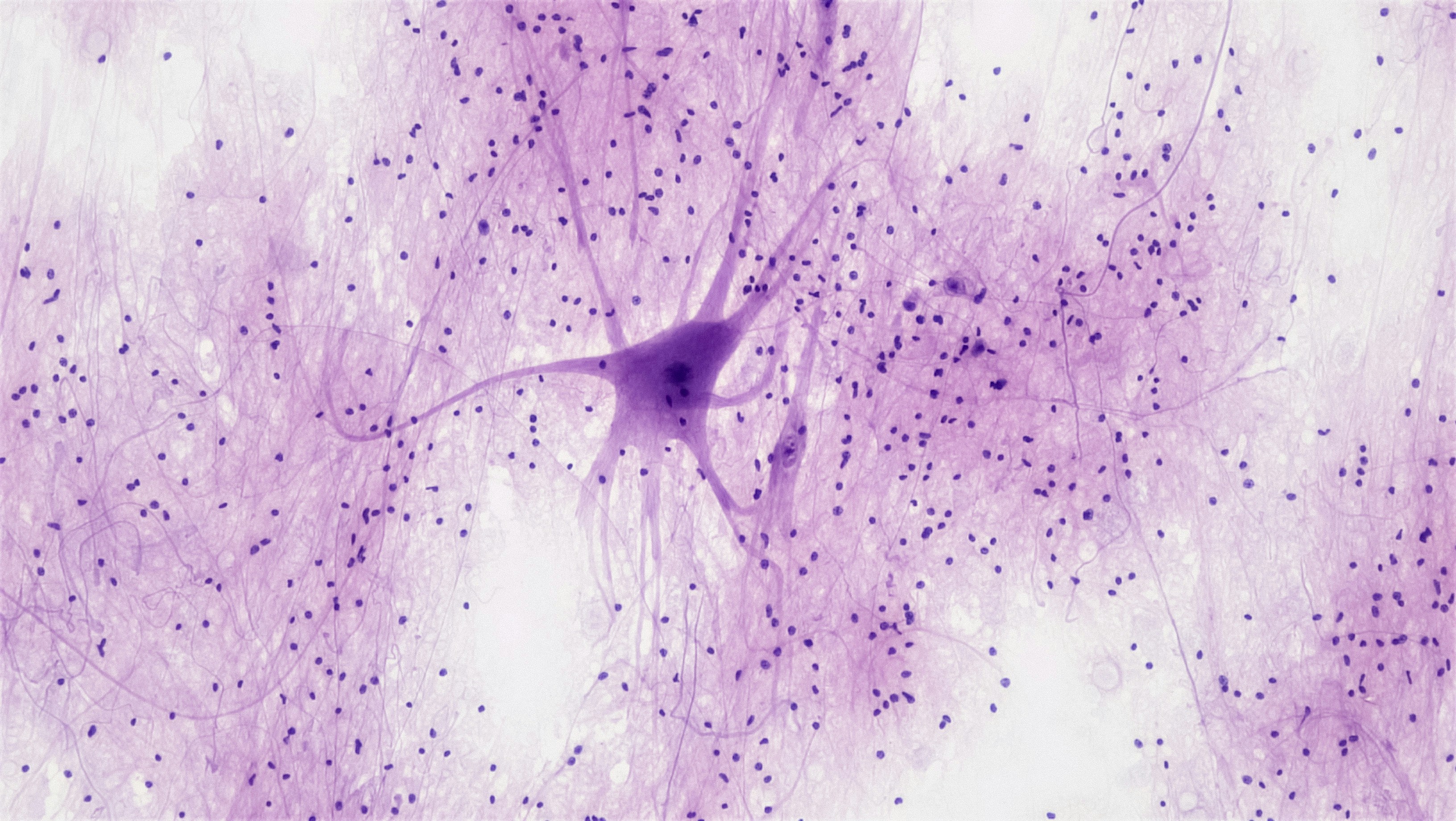

La interpretabilidad de los modelos de lenguaje ha avanzado hacia técnicas que permiten identificar con precisión quirúrgica las neuronas responsables de comportamientos específicos, como rechazar peticiones dañinas. En lugar de manipular el flujo residual completo —lo que a menudo degrada la coherencia del texto generado—, un enfoque emergente consiste en buscar pares contrastivos: comparar activaciones neuronales ante entradas inocuas frente a entradas maliciosas para localizar las unidades que más discriminan entre ambas. Esta estrategia, puramente basada en pasadas hacia adelante y sin necesidad de gradientes ni entrenamiento auxiliar, revela que apenas un 0,1% de las neuronas MLP concentran la capacidad de detectar intenciones hostiles. Al intervenir exclusivamente en ese pequeño conjunto, es posible reducir drásticamente las tasas de rechazo sin sacrificar fluidez ni provocar degeneración en la salida. Este hallazgo tiene implicaciones profundas para el desarrollo de sistemas seguros y controlables: en lugar de aplicar parches genéricos, las organizaciones pueden diseñar mecanismos de defensa finos que preserven la utilidad del modelo.

Para una empresa que integra ia para empresas en sus flujos de trabajo, contar con herramientas de inspección interna permite auditar y verificar que los asistentes conversacionales rechacen únicamente lo que deben rechazar, sin volverse excesivamente restrictivos o inconsistentes. La técnica de búsqueda contrastiva también abre la puerta a personalizar el comportamiento de agentes IA sin necesidad de reentrenar el modelo completo, lo que acelera la adaptación a dominios específicos como atención al cliente, cumplimiento normativo o moderación de contenido. Al mismo tiempo, esta capacidad de intervención selectiva refuerza la ciberseguridad de los despliegues, ya que permite detectar y neutralizar intentos de jailbreak sin interferir en el rendimiento general del sistema.

Desde una perspectiva práctica, la identificación de circuitos neuronales discriminativos facilita la creación de aplicaciones a medida que requieren un control granular sobre los límites éticos y funcionales del modelo. Por ejemplo, un software a medida para moderación de foros puede beneficiarse de un módulo que, sin actualizar el modelo base, ajuste dinámicamente el umbral de rechazo según el contexto. Esta misma lógica se extiende a plataformas que operan sobre servicios cloud aws y azure, donde la eficiencia computacional es crítica: intervenir en un puñado de neuronas consume órdenes de magnitud menos recursos que ejecutar un clasificador adicional o re-prompting costoso. Además, la capacidad de aplicar estas intervenciones en tiempo real se alinea con servicios inteligencia de negocio y dashboards que requieren respuestas consistentes y auditables, como los construidos con power bi.

La investigación detrás de la búsqueda contrastiva también revela que los modelos base —sin ajuste por instrucciones— ya poseen estructuras de discriminación en capas tardías, pero activar esas neuronas solo produce cambios de contenido, no de comportamiento. Es el proceso de alineamiento (fine-tuning con instrucciones) el que transforma esas estructuras preexistentes en una puerta de rechazo dispersa y localizable. Este descubrimiento sugiere que el alineamiento no crea nuevas capacidades sino que reorganiza las existentes, lo que tiene consecuencias directas para estrategias de seguridad y para el diseño de futuros modelos. En este contexto, contar con un socio tecnológico que comprenda tanto la teoría como la implementación práctica es esencial. Q2BSTUDIO, como empresa de desarrollo de software y tecnología, ofrece precisamente esa combinación de conocimiento profundo en inteligencia artificial y capacidad de entrega de soluciones robustas.

La capacidad de modular el comportamiento de un modelo de lenguaje sin sacrificar calidad abre un abanico de posibilidades en automatización de procesos, cumplimiento normativo y personalización. Al integrar estas técnicas en arquitecturas de producción, las empresas pueden desplegar asistentes que se adaptan dinámicamente a distintos perfiles de usuario o a normativas cambiantes. Y todo ello respaldado por una infraestructura que puede gestionarse mediante servicios cloud aws y azure, garantizando escalabilidad y disponibilidad. En definitiva, la búsqueda contrastiva de neuronas ilustra cómo la interpretabilidad deja de ser un ejercicio académico para convertirse en una palanca operativa que potencia tanto la seguridad como la flexibilidad de los sistemas basados en lenguaje.

Comentarios