Patrones sumidero vs. diagonales como mecanismos para el cambio de atención y la prevención del sobrealisamiento

En el ámbito de la inteligencia artificial y el deep learning, las arquitecturas basadas en transformers han revolucionado el procesamiento del lenguaje natural y más allá. Sin embargo, un fenómeno recurrente que limita su rendimiento es el sobrealisamiento: la tendencia de las representaciones de los tokens a volverse demasiado similares tras múltiples capas de atención, perdiendo expresividad. Para mitigarlo, la investigación ha explorado mecanismos como los patrones sumidero y las configuraciones diagonales en las matrices de atención. Estos mecanismos actúan como interruptores que redirigen el flujo de información, evitando que el modelo se estabilice en estados homogéneos. Desde una perspectiva práctica, comprender estas dinámicas es crucial para diseñar modelos de ia para empresas que requieran generalización robusta y capacidad de abstracción, especialmente en aplicaciones donde la diferenciación semántica es crítica.

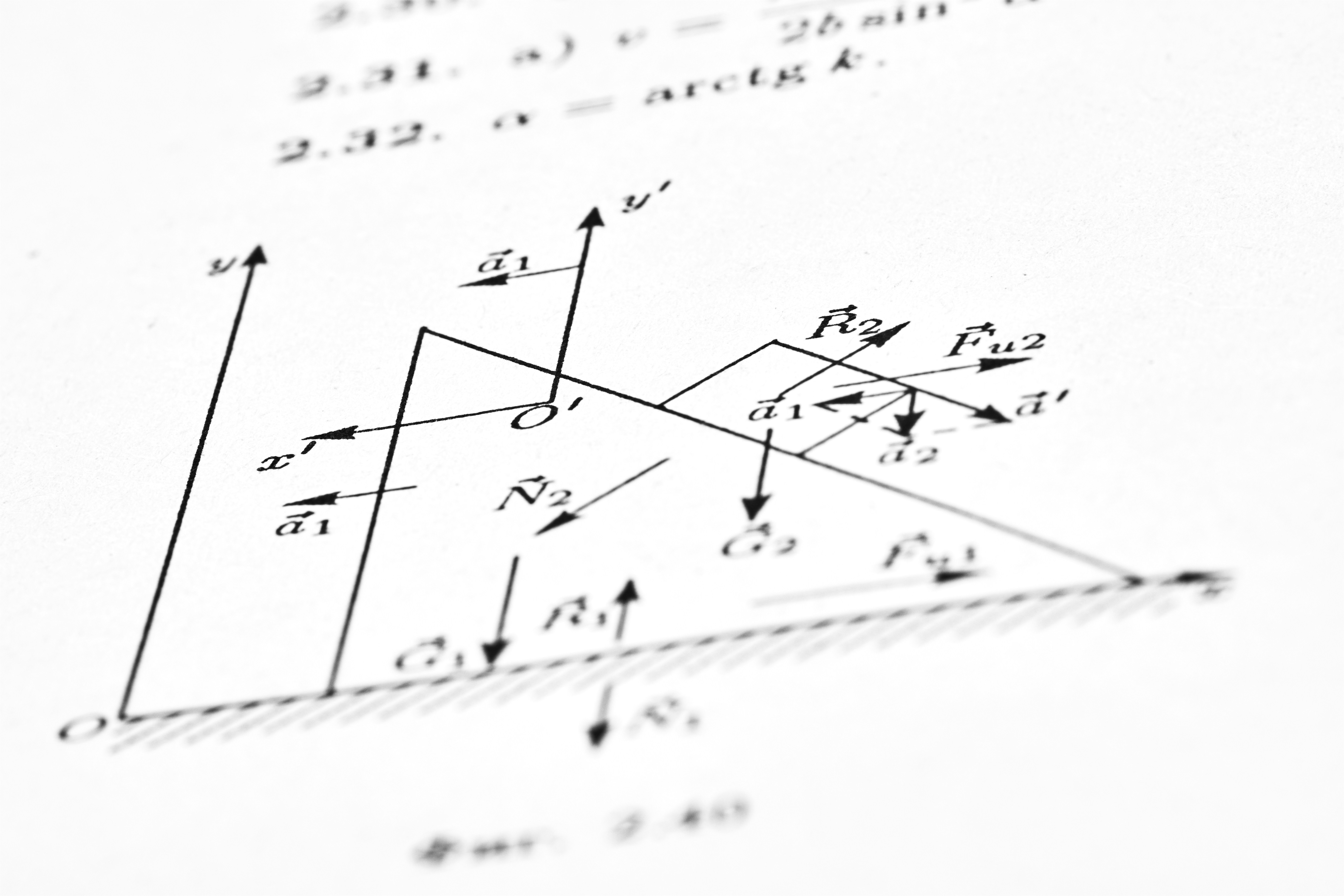

Los patrones sumidero funcionan como puntos de anclaje: ciertos tokens absorben una cantidad desproporcionada de atención, funcionando como un conmutador que desactiva la comunicación entre el resto. Esto contrasta con los patrones diagonales, donde cada token se comunica predominantemente consigo mismo. Ambos evitan el sobrealisamiento, pero con costos computacionales y de representación distintos. Mientras que los sumideros tienden a ser favorecidos en modelos preentrenados por su eficiencia, las diagonales ofrecen un control más fino. Esta dualidad recuerda al equilibrio que buscamos en el desarrollo de software a medida: no existe una solución única, sino que cada escenario demanda un balance entre flexibilidad y rendimiento, algo que abordamos en nuestras soluciones de inteligencia artificial para entornos empresariales.

La necesidad de prevenir el sobrealisamiento no es solo teórica. En sistemas reales, como los agentes IA que procesan grandes volúmenes de datos heterogéneos, la capacidad de mantener representaciones distintivas es clave para tareas de clasificación, razonamiento y generación. Por ejemplo, en un sistema de servicios inteligencia de negocio implementado con power bi, un modelo de atención mal calibrado podría homogeneizar indicadores, enmascarando anomalías críticas. De ahí que las técnicas de atención switch y diagonales tengan implicaciones directas en la calidad del análisis. Q2BSTUDIO integra estos principios en sus desarrollos de aplicaciones a medida, asegurando que cada capa de procesamiento preserve la riqueza informativa necesaria para la toma de decisiones.

Desde el punto de vista de la infraestructura, implementar estos mecanismos a gran escala exige entornos cloud robustos. Las arquitecturas que combinan sumideros y diagonales pueden beneficiarse de servicios cloud aws y azure para distribuir la carga computacional sin sacrificar latencia. Además, la ciberseguridad juega un rol transversal: al manipular las matrices de atención se alteran los flujos de datos, y un diseño descuidado podría exponer vulnerabilidades. Por ello, en cada proyecto de ia para empresas contemplamos tanto la eficiencia algorítmica como la protección de la información, integrando prácticas de ciberseguridad desde la fase de diseño.

En definitiva, la investigación sobre patrones sumidero y diagonales revela que la prevención del sobrealisamiento no es un detalle menor, sino un pilar para construir modelos profundos realmente útiles. Cada nueva comprensión sobre cómo y cuándo aplicar estos mecanismos acerca la teoría a la práctica industrial. En Q2BSTUDIO, aplicamos estos conocimientos para desarrollar software a medida que no solo ejecuta tareas, sino que aprende de forma estable y diferenciada, ofreciendo a las empresas la capacidad de extraer valor real de sus datos sin caer en representaciones planas y redundantes.

Comentarios