Complejidad parametrizada de la prueba de estacionariedad para funciones afines por partes y pérdidas de CNN superficiales

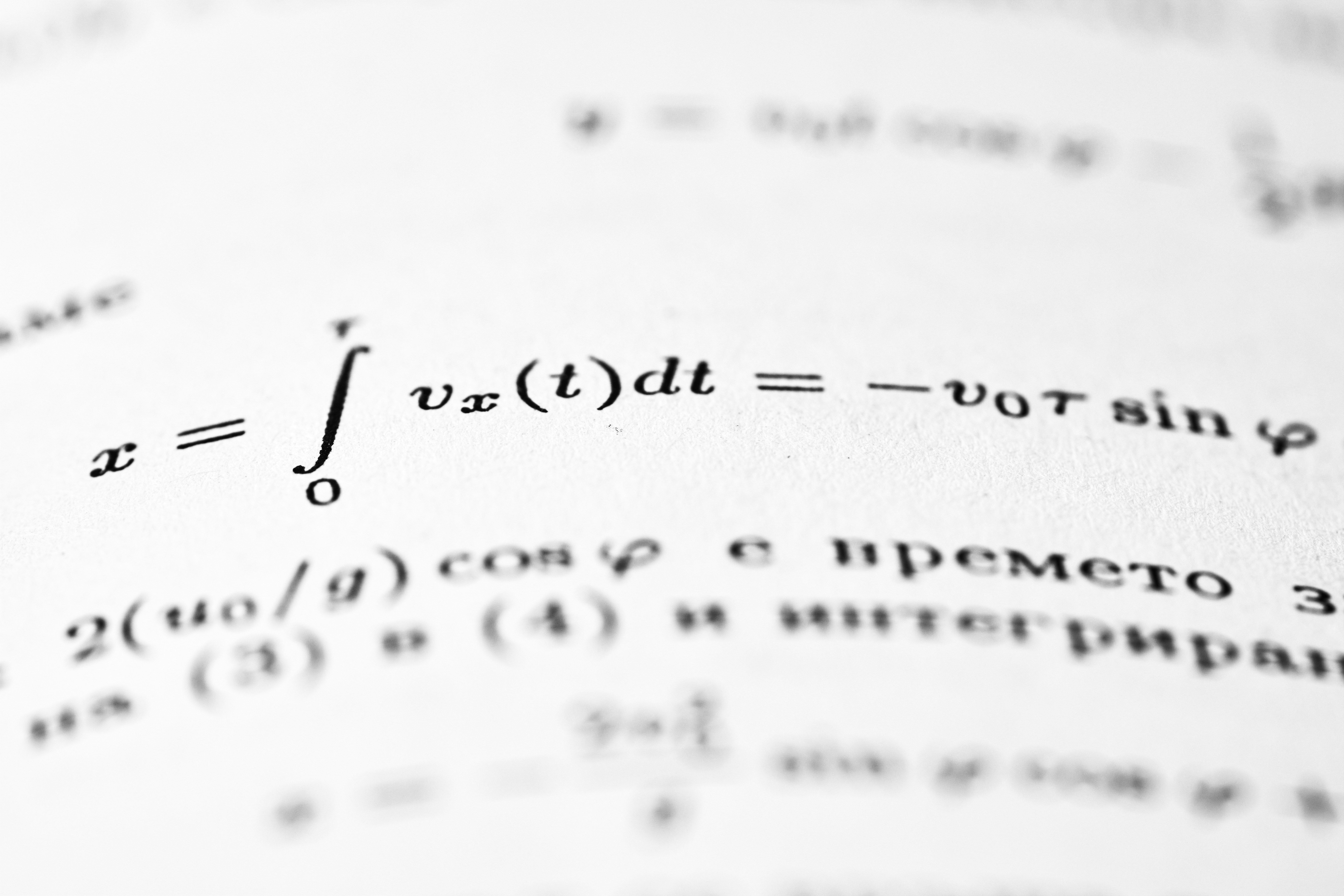

La optimización de modelos basados en redes neuronales profundas se enfrenta a un desafío matemático fundamental: verificar si un punto dado es estacionario en funciones no suaves, como las que surgen de activaciones ReLU. Estas funciones son afines por partes y modelan el paisaje local poliedral que aparece en pérdidas de entrenamiento típicas. La complejidad computacional de esta verificación crece de forma explosiva con la dimensión del espacio de parámetros, un fenómeno que los investigadores han empezado a caracterizar mediante la teoría de complejidad parametrizada. Resultados recientes muestran que, aunque para una dimensión fija existen algoritmos con tiempo polinómico (clase XP), en general el problema es W[1]-duro, lo que implica que no es tratable de manera eficiente cuando la dimensión es parte de la entrada, a menos que se cumplan ciertas hipótesis. Además, bajo la Hipótesis del Tiempo Exponencial (ETH), se descartan algoritmos cuyo tiempo de ejecución sea subexponencial en la dimensión. Este tipo de análisis no solo tiene implicaciones teóricas, sino que afecta directamente al diseño de soluciones prácticas para entrenar modelos de inteligencia artificial.

En el contexto empresarial, la necesidad de implementar ia para empresas que sean robustas y escalables obliga a considerar estas limitaciones. Por ejemplo, las pérdidas de redes convolucionales superficiales (CNN) presentan la misma estructura de complejidad parametrizada, lo que significa que cualquier optimizador que intente verificar estacionariedad en el espacio de pesos debe lidiar con la maldición de la dimensionalidad. Aquí es donde el desarrollo de aplicaciones a medida se vuelve crucial: permiten integrar algoritmos de optimización especializados que evitan la verificación exhaustiva, utilizando enfoques como agentes IA que exploran el paisaje de forma adaptativa o servicios cloud aws y azure para escalar horizontalmente los cálculos. Empresas como Q2BSTUDIO ofrecen software a medida que incorpora técnicas de inteligencia artificial adaptadas a problemas concretos, además de servicios complementarios como ciberseguridad para proteger los datos de entrenamiento y servicios inteligencia de negocio con power bi para monitorear el rendimiento de los modelos.

La clave está en entender que la complejidad teórica no debe paralizar el desarrollo práctico, sino guiar la creación de herramientas más inteligentes. Por eso, Q2BSTUDIO apuesta por soluciones que combinan la potencia de la nube con algoritmos de optimización hechos a medida, permitiendo a las organizaciones aprovechar al máximo los avances en ia para empresas sin quedar atrapadas en la intratabilidad computacional. La reflexión final es clara: la ciencia de la complejidad informa la ingeniería de software, y un enfoque parametrizado ayuda a diseñar sistemas que sean eficientes en las dimensiones que realmente importan para cada caso de uso.

Comentarios