Claude Code, Gemini CLI, GitHub Copilot Agents Vulnerable to Prompt Injection via Comments

En la actualidad, la intersección entre la inteligencia artificial (IA) y la seguridad informática es un tema de creciente relevancia dentro del ámbito tecnológico. Recientemente, un investigador ha puesto de manifiesto un nuevo método de ataque denominado 'Comment and Control', que revela vulnerabilidades en herramientas como Claude Code, Gemini CLI y GitHub Copilot. Este descubrimiento subraya la necesidad de adoptar enfoques robustos en ciberseguridad, especialmente para empresas que están incorporando agentes IA en sus procesos.

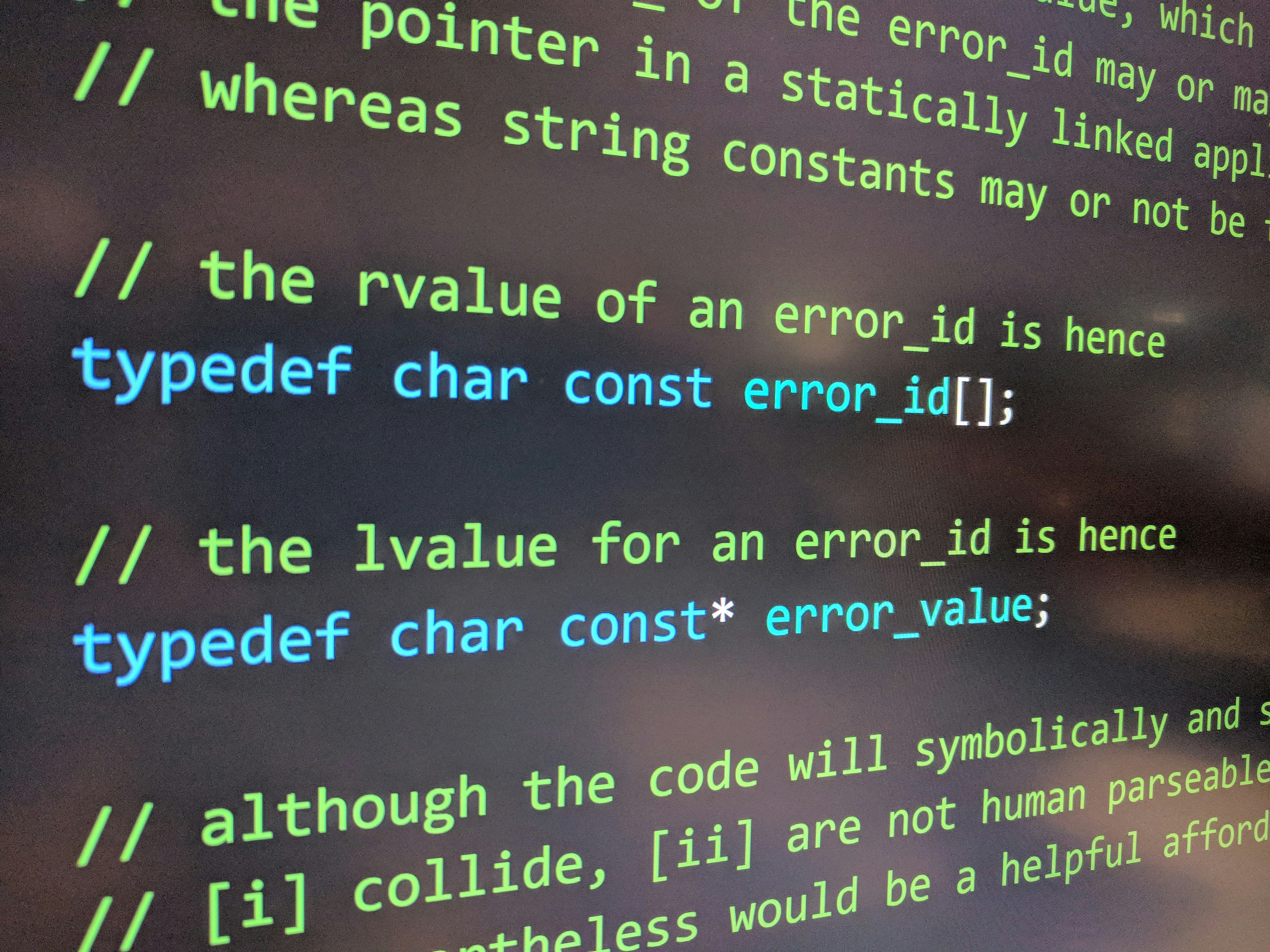

El ataque por inyección a través de comentarios pone en evidencia cómo la manipulación de inputs aparentemente inofensivos puede llevar a la ejecución de comandos no deseados. Esta técnica no solo afecta a los entornos de desarrollo, sino que también abre la puerta a posibles brechas de seguridad que ponen en riesgo la integridad de las aplicaciones a medida que implementan inteligencia artificial. Por ello, es crucial que las organizaciones adopten estrategias preventivas al integrar capacidades de IA en sus sistemas.

Los desarrolladores de software, como los profesionales de Q2BSTUDIO, deben tener en cuenta este tipo de amenazas al crear aplicaciones a medida que emplean inteligencia artificial. La protección contra estas vulnerabilidades y el fortalecimiento de la ciberseguridad se convierten en elementos esenciales. Utilizar prácticas de codificación segura y realizar auditorías regulares son pasos fundamentales en la gestión del riesgo asociado a la IA.

Además, al considerar la implementación de IA en contextos empresariales, resulta fundamental contar con soluciones de ciberseguridad adecuadas. Servicios como el ofrecido por Q2BSTUDIO en el ámbito de la ciberseguridad, pueden facilitar a las organizaciones la identificación y mitigación de vulnerabilidades antes de que puedan ser explotadas por cibercriminales.

La era digital exige no solo la adopción de tecnologías avanzadas, sino también la implementación de políticas de seguridad estrictas. Esto incluye la integración de soluciones en la nube, tanto en AWS como en Azure, que pueden proporcionar una capa adicional de protección y escalabilidad. Al priorizar la seguridad en cada fase del desarrollo de software, las empresas podrán maximizar los beneficios de la inteligencia artificial mientras minimizan los riesgos asociados.

En conclusión, a medida que la tecnología avanza, también lo hacen las técnicas de ataque. La consciencia sobre estas vulnerabilidades y la inversión en ciberseguridad serán determinantes para el éxito de las aplicaciones que emplean inteligencia artificial y otros recursos tecnológicos en un entorno empresarial cada vez más complejo.

Comentarios